Will Cathcart, l’uomo a capo di WhatsApp, punta il dito contro Apple per la scelta di implementare nei futuri iOS 15, iPadOS 15 e macOS Montery, un sistema di controllo che negli USA consentirà di rilevare immagini contenenti abusi sessuali su minori e a segnalarli quando caricate sul iCloud Foto.

Cathcart ha reso nota la sua posizione in una serie di tweet, affermando che il metodo scelto da Apple per combattere gli abusi sessuali commessi sui minori (acronimo “CSAM” negli USA) rappresenterebbe “un passo nella direzione sbagliata” e “uno smacco per la privacy delle persone in tutto il mondo”.

“Apple doveva da tempo fare di più per combattere la diffusione di materiale pedopornografico, ma l’approccio che stanno adottando rappresenta qualcosa di molto preoccupante per tutti”, riferisce Cathcart. “Anziché concentrarsi rendendo più facile per le persone segnalare contenuti che altri hanno condiviso con loro, Apple ha creato un software che può scansionare tutte le foto private sul vostro telefono, anche foto che non sono state condivise con nessuno; questa non è privacy”.

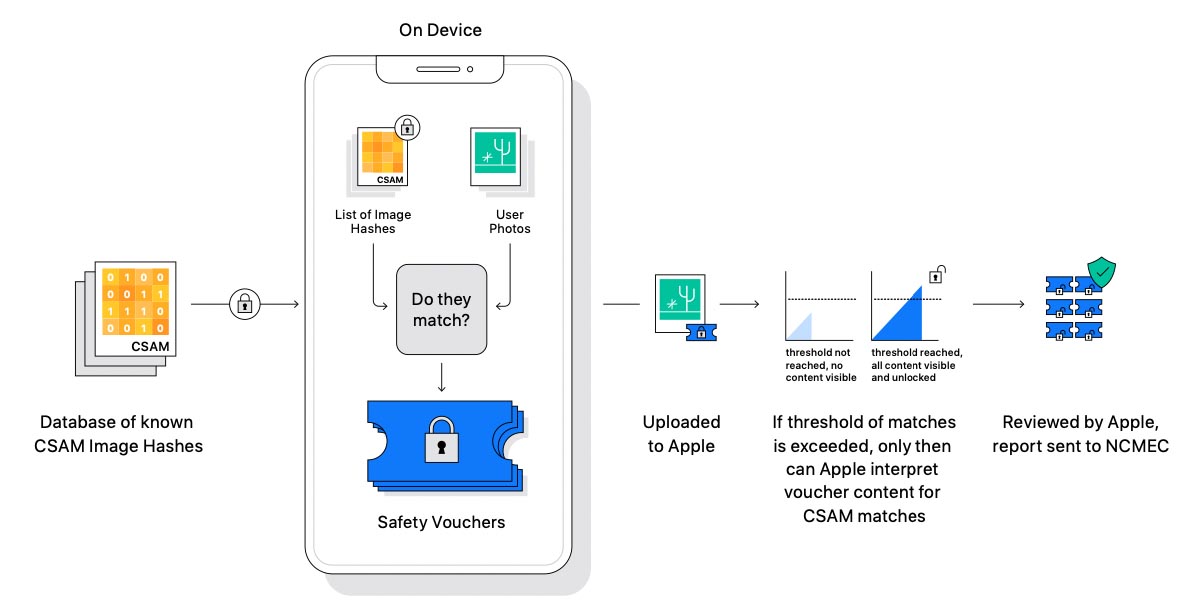

La tecnologia di Apple prevede la scansione delle foto caricate dall’utente su iCloud, confrontando gli scatti sulla “nuvola” con foto note di abusi alla ricerca di similitudini. Prima dell’eventuale segnalazione alle organizzazioni per la sicurezza dei bambini, vengono effettuati ulteriori controlli da parte di persone incaricate delle verifiche.

Alcuni esperti e diverse organizzazioni per i diritti digitali hanno espresso preoccupazioni in merito (inclusi Edward Snowden e la Electronic Frontier Foundation), evidenziando che funzionalità simili in futuro potrebbero essere sfruttate per identificare non solo materiale pedopornografico ma anche altri tipi di immagini (es. simboli e foto non gradite a governi e regimi vari).

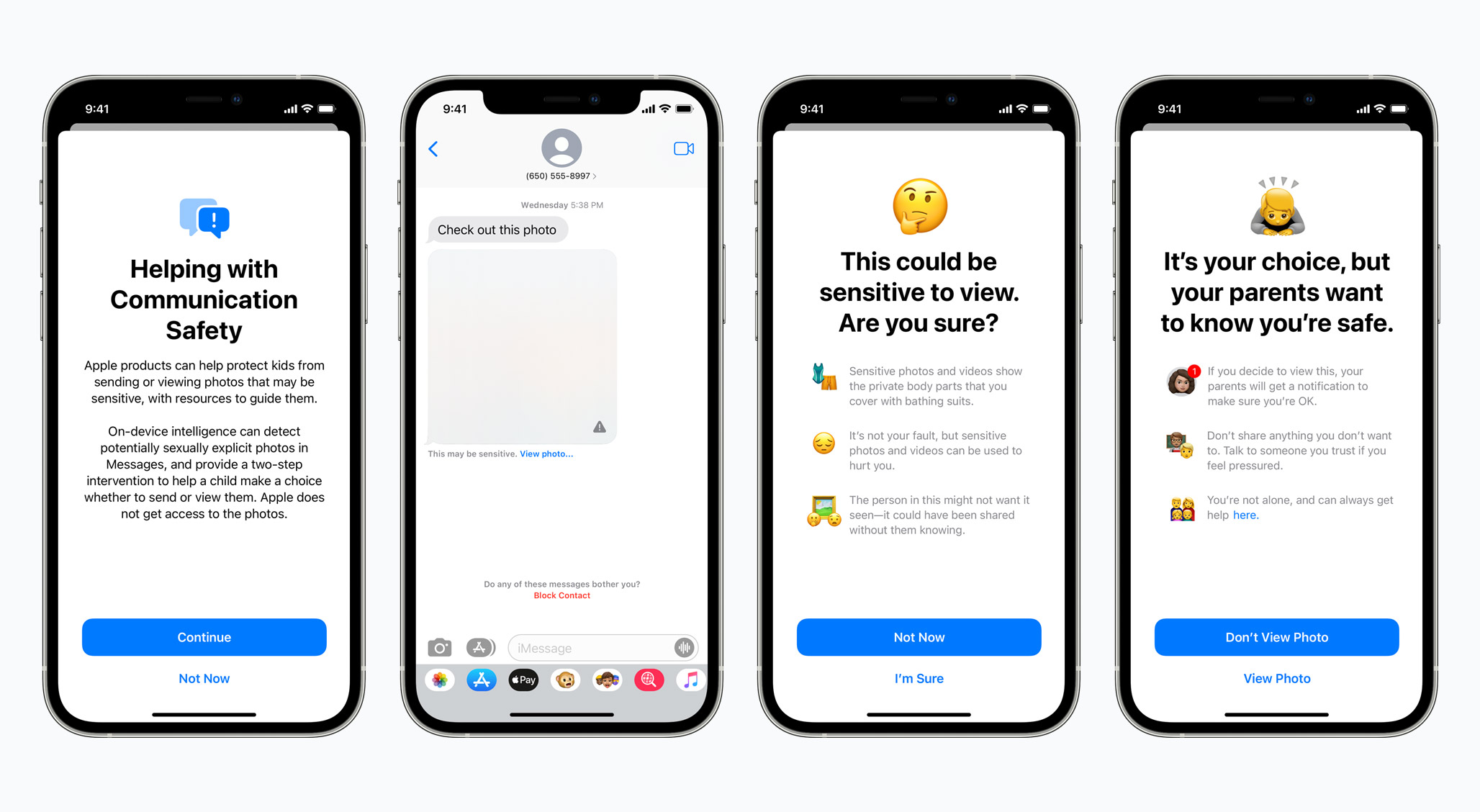

Cathcart evidenzia ancora un diverso problema con l’app Messaggi di Apple. Nell’app in questione, immagini sessualmente esplicite verranno identificate e automaticamente offuscate se l’utente che le riceve ha meno di 17 anni. Inoltre, i genitori potranno scegliere la ricezione di notifiche quando ragazzi di meno di 13 anni inviano o ricevono messaggi con questo tipo di materiale. L’analisi delle immagini avviene direttamente sul dispositivo, sfruttando tecnologie di machine learning.

“Ho letto le informazioni indicate da Apple ieri e sono preoccupato”, ha scritto ancora Cathcart. “Penso che tale approccio sia sbagliato e un regresso per la privacy di tutte le persone”. “Le persone hanno chiesto se anche noi adotteremo questo sistema per WhatsApp. La risposta è no”.

Cathcart riferisce che WhatsApp collabora per combattere la pedopornografia e lo scorso anno ha segnalato oltre 400.000 casi al National Center for Missing and Exploited Children (NCMEC), organizzazione non a scopo di lucro che si occupa – tra le altre cose – della tutela di minori scomparsi.

La critica di WhatsApp – società di Facebook – non sorprende: da tempo l’azienda di Zuckerberg sta combattendo una battaglia contro Apple, soprattutto dopo che quest’ultima ha deciso di adottare da iOS 14.5 in poi il meccanismo noto come App Tracking Transparency (ATT), obbligando gli sviluppatori di app a chiedere agli utenti il consenso esplicito prima di tracciare i comportamenti e usare i dati raccolti per scopi pubblicitari.

Il National Center for Missing and Exploited Children (NCMEC) ha invece lodato Apple per l’iniziativa, scrivendo una lettera di ringraziamento e incoraggiamento alla Casa di Cupertino.