Un sito con una lettera aperta indirizzata a Apple e che tutti possono firmare, è stato predisposto da alcuni utenti per chiedere alla Casa di Cupertino di non portare avanti i piani che prevedono funzionalità per l’identificazione automatica di immagini pedopornografiche caricate su Foto per iCloud o scambiate dagli utenti con l’app Messaggi.

Il documento (che è possiible leggere e firmare qui) sembra un atto di accusa più che una lettera aperta, ed evidenzia una serie di problematiche dalla tecnologia predisposta da Apple a protezione dei monitori, elecando questioni già sollevate da esperti di sicurezza, secondo i quali il sistema di identificazione delle immagini potrebbe essere sfruttato in futuro da governi e regimi vari per obbligare Apple a segnalare la presenza di immagini con simboli o foto con eventi, persone, luoghi e altri elementi non graditi al regime.

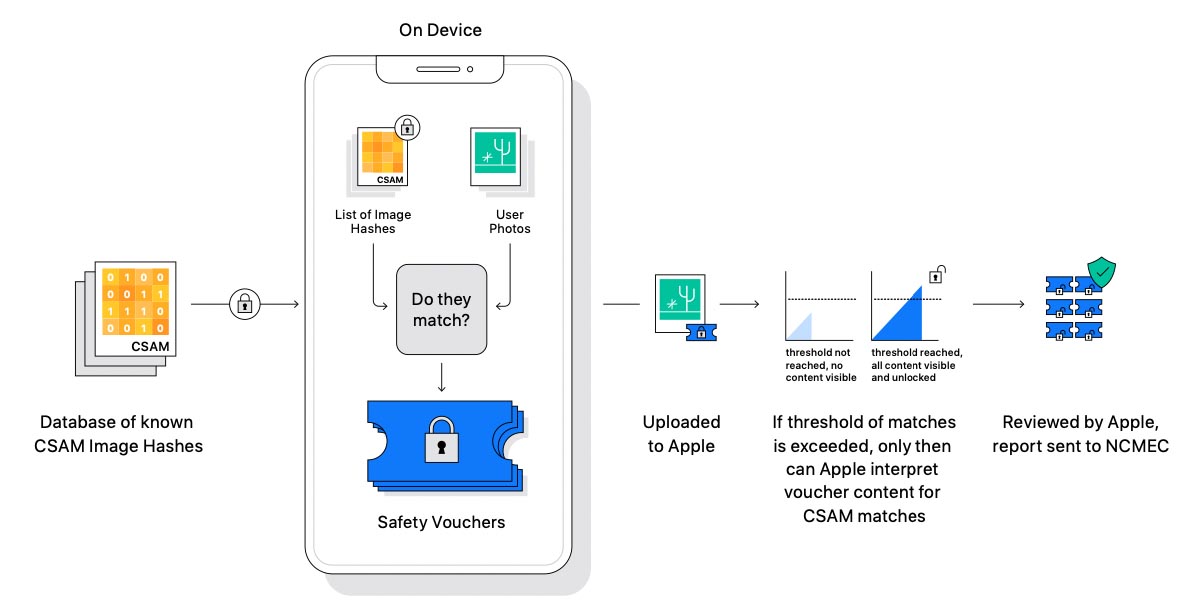

L’idea di Apple è quella di identificare immagini pedopornografiche caricate su iCloud, confrontando le immagini man mano caricate con un sistema che verifica la similitudine delle foto con altre presenti in archivi già note. L’eventuale segnalazione automatica farebbe ad ogni modo scattare una verifica da parte di personale dedicato, segnalando eventualmente il tutto al National Center for Missing and Exploited Children (NCMEC), organizzazione non a scopo di lucro che si occupa – tra le altre cose – della tutela di minori scomparsi.

“Lo sfruttamento dei minori è un problema serio”, si legge nella lettera, “e benché gli sforzi per combatterlo siano indiscutibilmente lodevoli, la proposta di Apple introduce una backdoor (una porta secondaria, ndr) che minaccia di minare il fondamentale diritto alla tutela della privacy per tutti gli utenti dei prodotti Apple”.

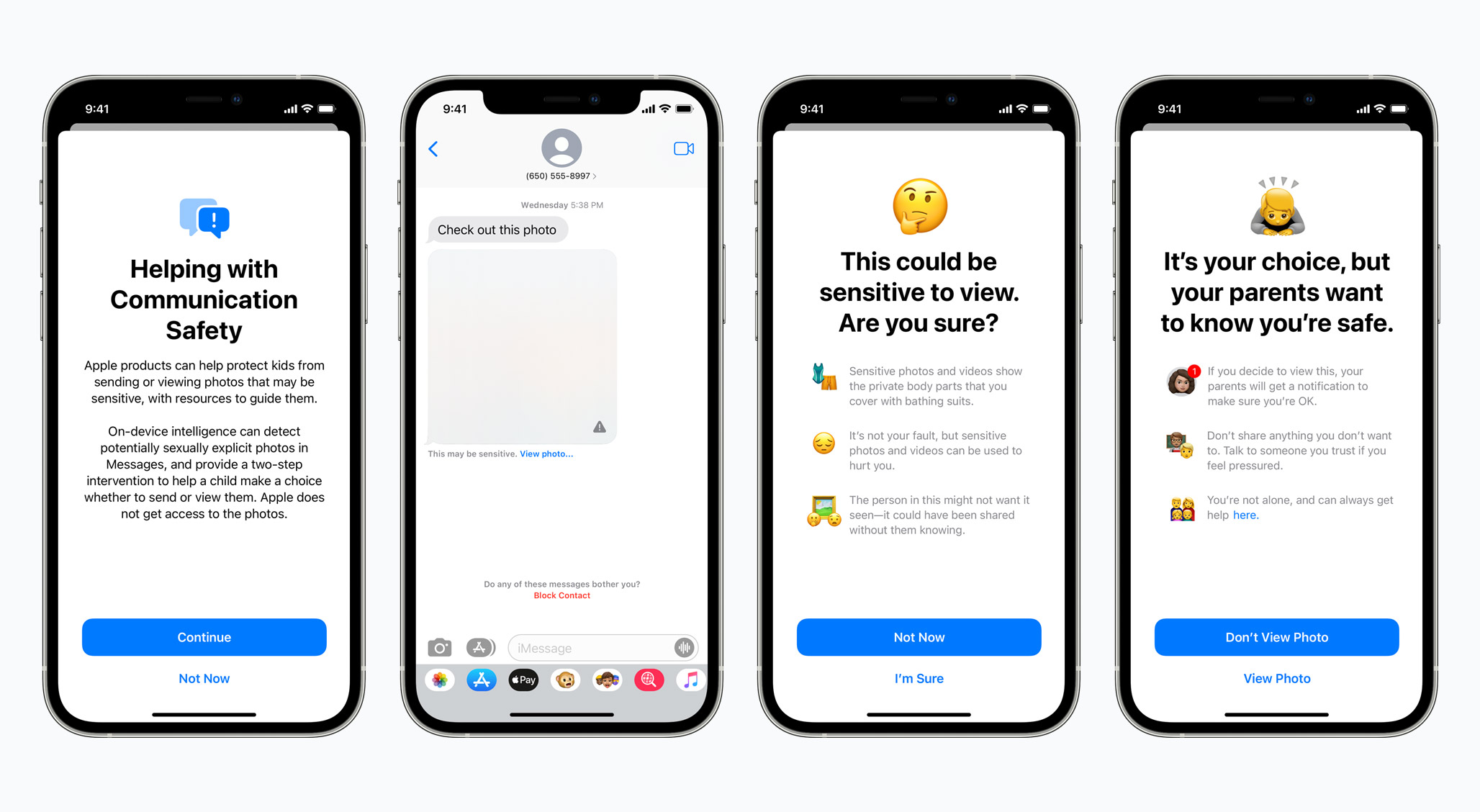

L’implementazione di Apple, come accennato, prevede il confronto delle foto caricate dall’utente su iCloud con quello che in gergo si chiama “hashing profondo per la ricerca di similarità”; la verifica viene effettuata solo per le immagini caricate su iCloud Foto (e per ora solo negli USA) ma un diverso sistema di protezione per i minori prevede un meccanismo che funziona sul dispositivo stesso e che blocca in automatico immagini sessualmente esplicite scambiate con l’app Messaggi, permettendo inoltre ai genitori di ricevere una notifica se avviene uno scambio con immagini di questo tipo.

Nella lettera aperta indirizzata a Apple si fa presente che la tecnica usata dalla Casa di Cupertino rappresenta un problema giacché bypassa la cifratura end-to-end (il sistema di comunicazione cifrata nel quale solo le persone che stanno comunicando possono leggere i messaggi, evitando a terze parti di intercettare i messaggi).

“Giacché entrambe le verifiche sono effettuate sul dispositivo dell’utente”, continua ancora la lettera, “è potenzialmente poossibile bypassare qualsiasi sistema di cifratura end-to-end che dovrebbe salvaguardare la privacy dell’utente”.

Di canto suo Apple, ribadisce che l’intenzione non è quella di creare “backdoor” che minano in qualche modo la sicurezza a livello hardware o software. Cupertino, tra l’altro, ha ricevuto plauso e incoraggiamento dalla National Center for Missing and Exploited Children (NCMEC).

Nella lettera indirizzata a Apple si evidenziano critiche di esperti vari, incluso Matthew Green, specialista in crittografia della Johns Hopkins University, tra i primi a riferire preoccupazioni per la scelta di Apple. Oltre a Green, anche Edward Snowden – il noto attivista e whistleblower statunitense – ha firmato la lettera inviata a Apple.

Il documento si conclude chiedendo alla Mela di rilasciare una dichiarazione per “ribadire il suo impegno a supporto della cifratura end-to-end e per la privacy dell’utente”.

![iGuide per i regali di Natale - macitynet..ti CTA Natale iGuida [per Settimio] - macitynet.it](https://www.macitynet.it/wp-content/uploads/2025/12/regali-di-natale-consigli-di-macitynet.jpg)