L’UE è vicina all’approvazione di nuove norme che renderanno obbligatoria la scansione di immagini inviate digitalmente, incluse quelle scambiate con app che usano protocolli cifrati, con sistemi operativi e gestori di servizi che dovranno tenere conto di meccanismi di rilevazione che dovrebbero aiutare a fronteggiare la diffusione online di materiale pedopornografico.

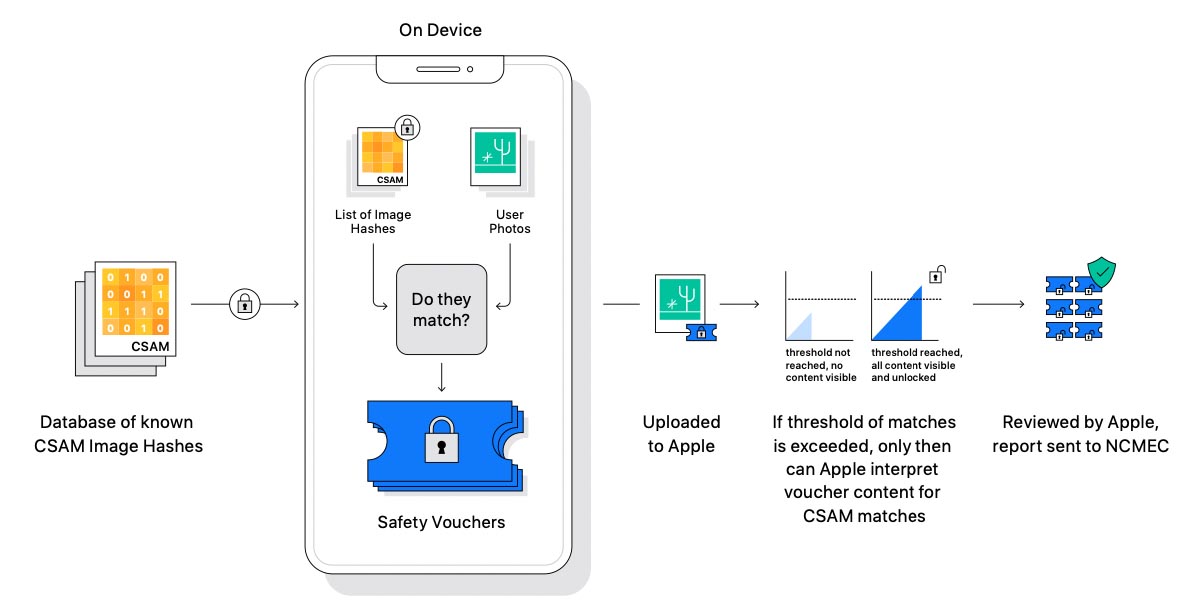

Lo riferisce The Verge spiegando che l’UE e suoi Stati membri si pronunceranno sulla proposta legislativa, pensata per individuare automaticamente materiale che ritrae abusi sessuali (quello che in gergo si chiama CSAM, da “Child Sexual Abuse Material”).

Nel 2022 la Commissione ha adottato una proposta legislativa che mira a prevenire e lottare contro l’abuso sessuale su minori rendendo obbligatorio per i prestatori di servizi segnalare casi di abuso sessuale su minori online sulle loro piattaforme e allertare le autorità.

Il sistema di moderazione degli upload, prevede la scansione di tutti i messaggi digitali, incluse immagini, video e link; ogni “prestatore di servizio” è obbligato a predisporre tecnologie di monitoraggio, con l’obiettivo di “contrastare efficacemente” l’abuso sessuale su minori online e tutelare le vittime grazie a strategie di protezione.

Per quanto concerne le app che sfruttano sistemi di cifratura, la proposta legislativa prevede di impedire l’uso di cifratura end-to-end, affermando che, benché si tratti di mezzi di tutela dei diritti fondamentali, questi meccanismi possono essere sfruttati inavvertitamente come zone sicure per condividere e diffondere materiale pedopornografico.

Meredith Whittaker, presidente responsabile di Signal Messanger, nota per l’omonima app per lo scambio di chat sicure e private, ha fatto sapere che se le norme entreranno in vigore l’app in questione non funzionerà più in Europa, spiegando che quanto proposto “compromette in maniera sostanziale” la cifratura, indipendentemente se la scansione avviene prima o dopo la cifratura. “Possiamo definirla un backdoor”, ha dichiarato Whittaker, affermando che comunque la si voglia chiamare, questo approccio crea vulnerabilità che possono essere sfruttate da cybercriminali e nazioni ostili, rimuovendo le protezioni degli algoritmi matematici, offrendo su un piatto di argento una vulnerabilità di alto livello.

Diverse organizzazioni, inclusa Electronic Frontier Foundation, il Center for Democracy & Technology, e Mozilla, hanno firmato una dichiarazione congiunta per chiedere all’UE di respingere la proposta di legge.

Apple aveva provato a implementare un suo sistema di scansione preventivo, ma poi era tornata sui suoi passi, dopo le segnalazioni di varie entità che indicavano la pericolosità di questo sistema, paventando la possibilità di aprire le porte a governi autoritari o scarsamente democratici, obbligando a segnalare anche altro materiale (es. meme di protesta politica o video e fotografie che documentano violenze da parte delle forze dell’ordine).

L’abbandono del rilevamento CSAM in iCloud è stato celebrato dai sostenitori della privacy. Allo stesso tempo, è stato condannato dai gruppi di sicurezza dei bambini, dalle forze dell’ordine e dai funzionari governativi.