[banner]…[/banner]

Apple sta lavorando a un paio di occhiali per realtà aumentata e l’iPhone potrebbe fungere da controller. È quanto si apprende da un nuovo brevetto che descrive un sistema capace di combinare i due dispositivi per garantire una migliore fusione tra Realtà Aumentata e mondo reale.

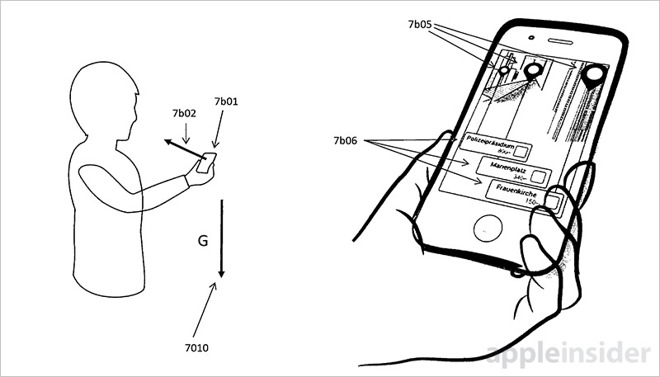

Nello specifico questi occhiali smart, dotati di schermo semi-trasparente, sarebbero capaci di posizionare con precisione elementi tridimensionali nel mondo circostante, sfruttando sensori e GPS per calcolare l’esatta posizione dell’utente. Nell’esempio documentato viene mostrata l’evoluzione di un’applicazione per le Mappe, che segna percorsi e punti di interesse nell’ambiente circostante.

Tale sistema sarebbe un’alternativa a quanto abbiamo in parte già visto da uno dei recenti video di applicazioni sviluppate con ARKit, dove l’utente semplicemente inquadrava il mondo circostante con l’iPhone per vedere le indicazioni stradali su muri e strade attraverso la fotocamera del dispositivo.

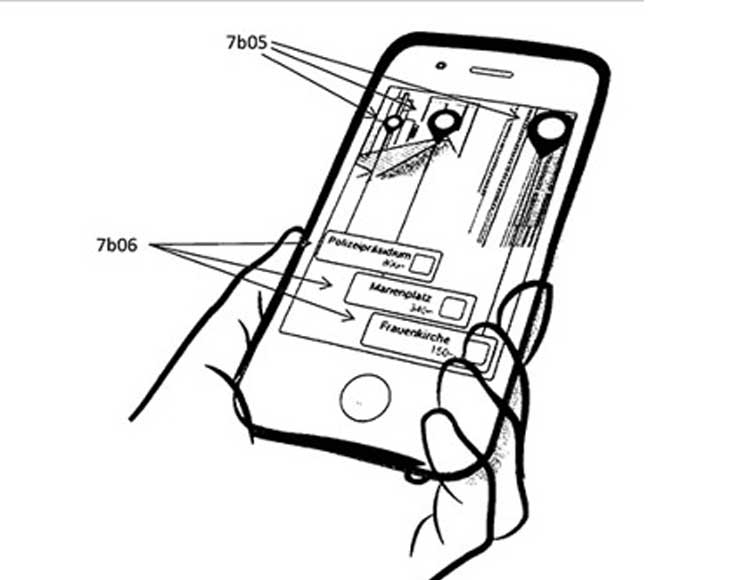

Qui però l’iPhone avrebbe un altro ruolo, quello di controller per interagire con il software: occhiali come questi infatti non potrebbero offrire un’interazione touch come quella a cui siamo abituati con lo schermo degli smartphone. Ecco che quindi il sistema sarebbe in grado di riconoscere la posizione del dito dell’utente sullo schermo, virtualizzando probabilmente un cursore sul display degli occhiali per permettere all’utente di effettuare click e selezioni.

Continuando sull’esempio evidenziato dal brevetto, i cui dettagli sono stati resi noti dal sito AppleInsider, punti di riferimento, edifici noti e altri oggetti tipici sono comunemente denominati POI (“Point Of Interest”) nelle applicazioni di mapping, inclusa l’app Mappe di Apple stessa. La Casa di Cupertino integra già POI per alcune funzionalità di ricerca in Mappe; sono usati, ad esempio per cercare ristoranti e stazioni di servizio. La proprietà intellettuale per la quale Apple ha chiesto il brevetto, va oltre i punti di interesse visualizzabili su una mappa in due dimensioni, prevedendo modalità utilizzabili nell’ambito della Realtà Aumentata.

Nello specifico è previsto quando mostrare POI nelle vicinanze, visualizzando quali rilevanti o in qualche modo vicini alla vista nel mondo reale. Sfruttando dati relativi a latitudine, longitudine e altitudine, il sistema può elaborare l’ubicazione rispetto ai POI target visualizzando dettagli sullo schermo.

Dopo avere determinato la posizione dei POI, indicazioni grafiche con annotazioni interattive sono sovrapposte sull’immagine catturata. I sensori, inclusi quelli di profondità di future fotocamere, possono essere sfruttati per collocare marcatori in punti ben determinati. Gli indicatori sono in qualche modo ancorati alle rispettive controparti presenti nel mondo reale. Se, ad esempio, l’utente comincia a spostarsi a sinistra, gli edifici mostrati sullo schermo si spostano di conseguenza, così come i punti di interesse mostrati sul display, come se fossero “incollati” alle varie posizioni.

Nel brevetto si mostrano vari modi per interagire con i POI, tenendo ad esempio anche del modo in cui l’utente ha l’iPhone in mano (in verticale o in orizzontale). Il brevetto di Apple è un’estensione di un brevetto che era stato registrato dalla tedesca Metaio, azienda specializzata in Realtà Aumentata acquisita da Cupertino nel 2015.