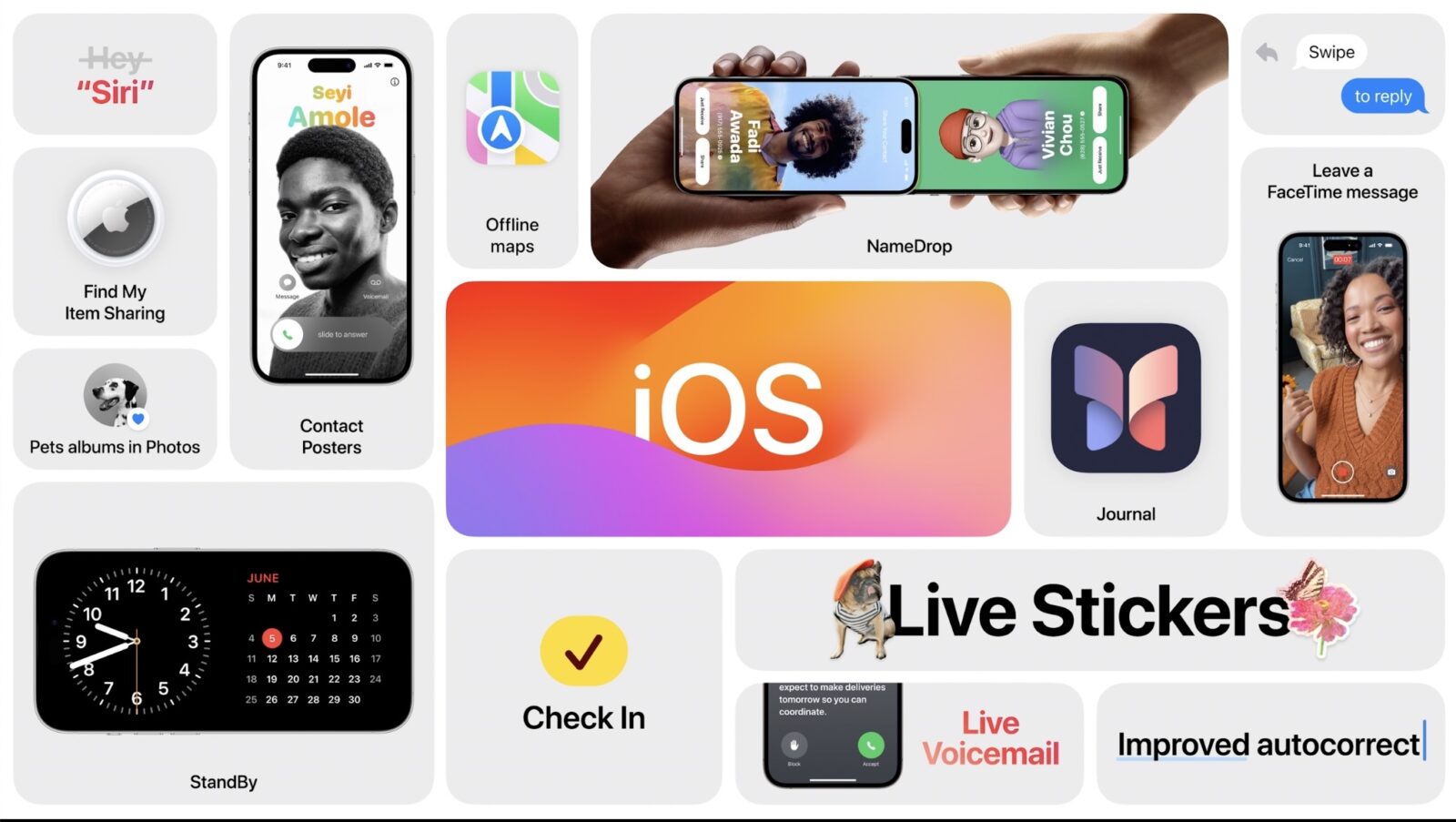

iOS 17 integra nuove funzionalità che rendono ancora più semplice condividere determinati elementi usando AirDrop (è ad esempio possibile condividere informazioni di contatto semplicemente avvicinando il proprio iPhone a quello dell’altra persona, o tra iPhone e Apple Watch, così come condividere contenuti), ma Apple ha anche integrato nuove misure che salvaguardano gli utenti contro eventuali abusi, incluso l’invio non richiesto e non desiderato di foto di nudo.

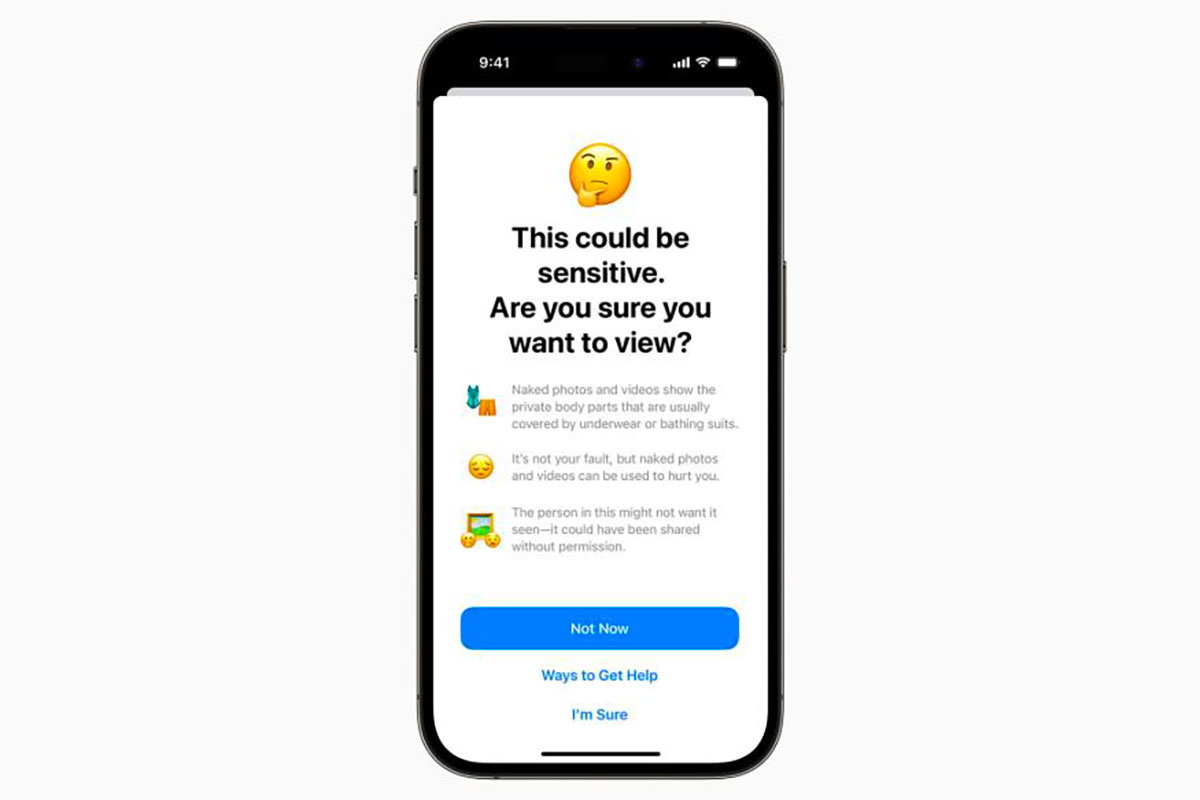

Tra le novità di iOS 17 c’è anche il Sensitive Content Warning, letteralmente traducibile in avviso sui contenuti sensibili, funzionalità che permette di impedire la visualizzazione di foto di nudità non richieste. Quando si ricevono immagini o filmati di questo tipo è possibile fare in modo che il sistema mostri un avviso chiedendo all’utente di scegliere se vederle oppure no.

La funzione in questione, riferisce il sito Engadget, è utile non solo con iMessage, ma anche con altre app. Le tecnologie di machine learning sono in grado di individuare e nascondere automaticamente contenuti sessualmente espliciti inviati con AirDrop, nei Contact Posters (una nuova funzione dell’app Telefono che permette di personalizzare la schermata in base a chi chiama), nei messaggi FaceTime e nella selezione delle Foto.

Oltre alle foto, come accennato, l’AI sfruttata da questa tecnologia, riconosce anche ciò che è presente nei filmati: se contenuti espliciti arrivano sul dispositivo possono essere automaticamente bloccati prima che l’utente li possa visualizzare.

Il Sensitive Content Warning funziona sul dispositivo (non richiede collegamenti e trasferimenti di dati via internet) e Apple riferisce che non conserva il materiale esaminato. Per sfruttare questa funzionalità bisogna attivare “In famiglia”, opzione che consente di condividere con i familiari l’accesso a vari servizi Apple.

Nel 2021 Apple aveva previsto funzionalità che avrebbero permesso di scansionare le foto caricate dagli utenti su iCloud consentendo di individuare materiale pedopornografico (CSAM, acronimo di Child Sexual Abuse Material), con l’obiettivo di riferire eventuali violazioni al National Center for Missing and Exploited Children (NCMEC), organizzazione non a scopo di lucro che si occupa – tra le altre cose – della tutela di minori.

Questa funzionalità è stata poi abbandonata in seguito a proteste e rimostranze di chi riteneva pericolosa la possibilità di segnalare falsi positivi. Tutte le novità dalla WWDC 2023 in questa pagina del nostro sito: i singoli articolisono raccolti nella sezione WWDC 2023.