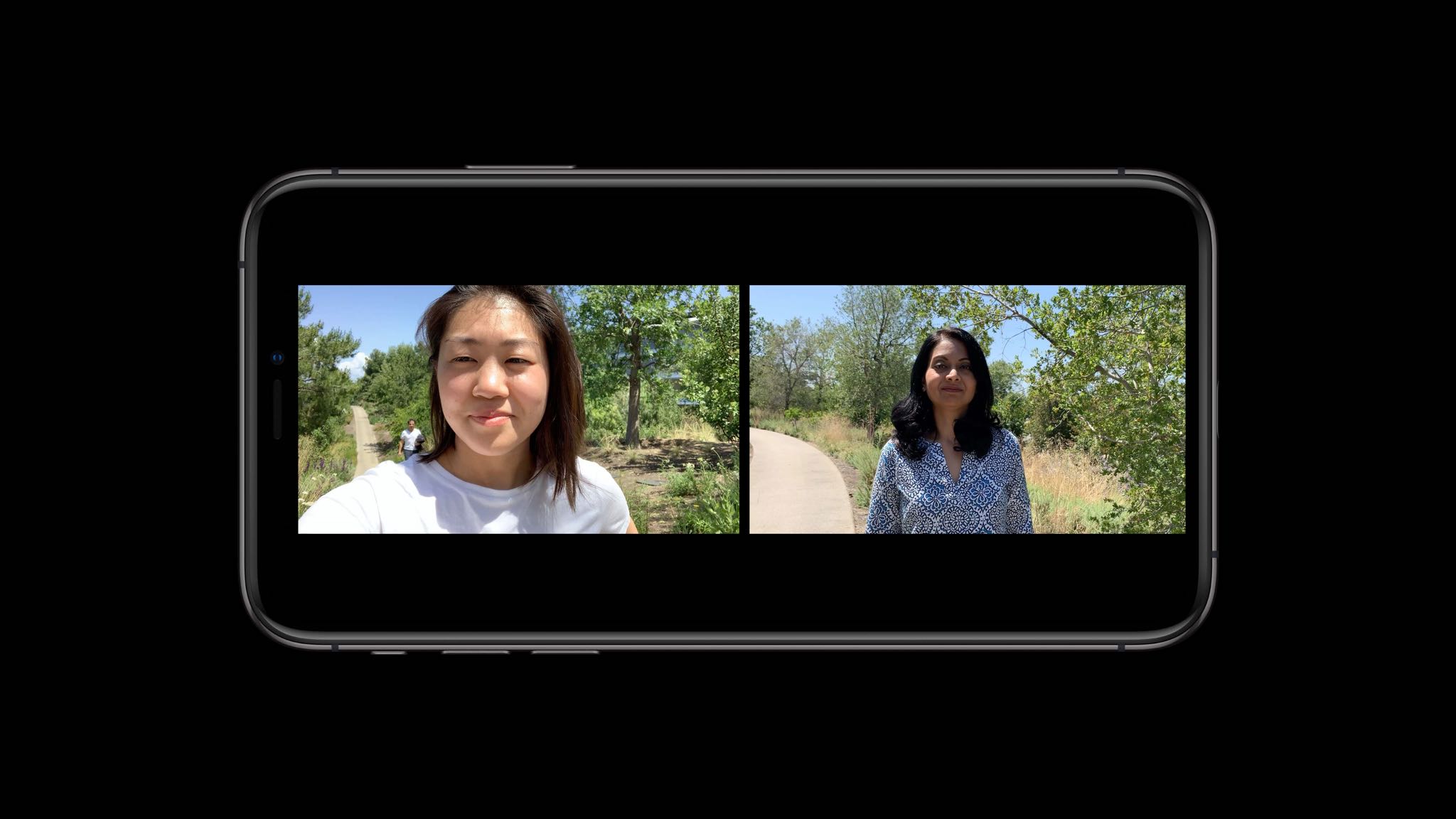

Tra le tante novità di iOS 13, ed in particolare tra quelle che riguardano il reparto fotografico, quella di poter utilizzare diverse fotocamere per scattare foto, registrare audio o video dalle diverse camere di iPhone, così da avere prospettive diverse all’interno di una stessa app.

Secondo la documentazione diffusa dalla stessa Apple, con iOS 13 sarà possibile catturare simultaneamente foto e video da più telecamere, e visualizzarle in tempo reale all’interno di una stessa app. Per poter sfruttare tale funzione, però, sarà necessario disporre di un dispositivo con chip Bionic A12, o versione più recente. A titolo di esempio, la cattura simultanea da telecamere anteriori e posteriori in un singolo file richiederà un iPhone XS, XS Max, iPhone XR, o un iPad Pro 2018.

Come la cattura RAW, non si tratta di una funzione inclusa nell’app nativa di Apple, bensì di una caratteristica che potrà essere inclusa dagli sviluppatori nelle proprie app, utilizzando le API ufficiali.

La funzione, nuova ai dispositivi iOS, è già supportata su macOS a partire da OS X Lion. La nuova documentazione afferma che sarà anche possibile configurare più microfoni su un dispositivo iOS per modellare il suono che viene catturato.

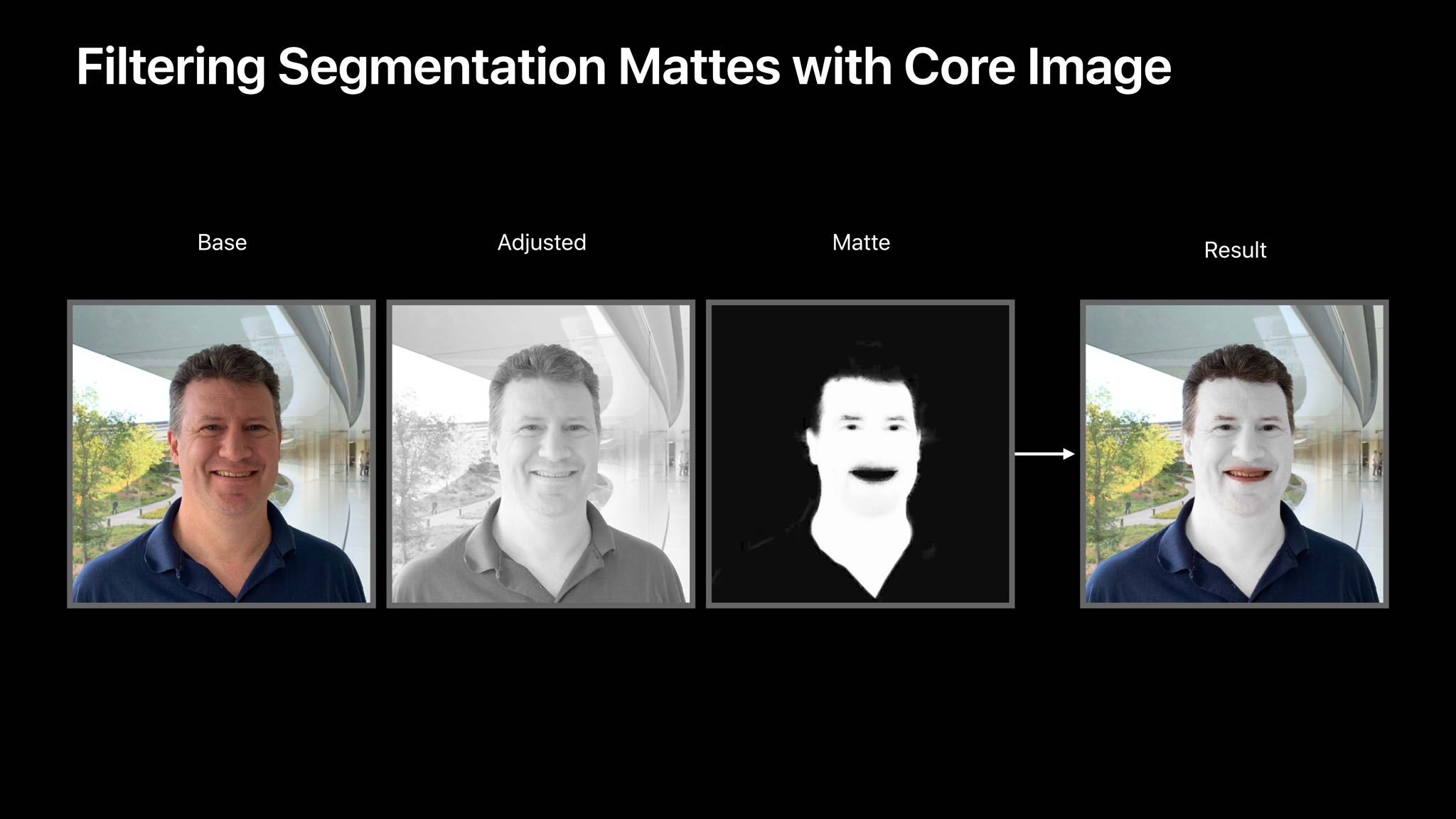

Questa, insieme ad altre novità, fa parte di una lunga serie di migliorie che Apple vuole apportare al suo reparto fotografico. A titolo di esempio, iOS 13 sfrutta anche il machine learning on-device per catturare e scomporre la foto in segmenti, come la possibilità di isolare i capelli, i denti, o parti della pelle.

Questa nuova funzionalità sarà presto incorporata in altre app fotografiche di terze parti e che renderà la ritrattistica fotografia ancor più complessa, a differenza degli effetti di iOS 12 che sono in grado solo di isolare l’intero soggetto dallo sfondo.

Si può facilmente immaginare un app in grado di isolare separatamente i capelli di un soggetto, la pelle o i denti in modo da poter intervenire solo su questi elementi, per applicare effetti mirati o effettuare regolazioni di colore ben specifiche.