La star di intelligenza artificiale AI del momento torna sul palco con una novità attesa da mesi: finora abbiamo giocato con ChatGPT basata sul precedente modello AI GPT-3 risalente al 2020, nelle scorse ore OpenAI ha annunciato il nuovo modello GPT-4 molto più potente, capace e utile, sicuro e affidabile rispetto al predecessore, rispetto al quale migliora sotto ogni punto di vista.

GPT-4 capisce e interpreta immagini, foto e documenti

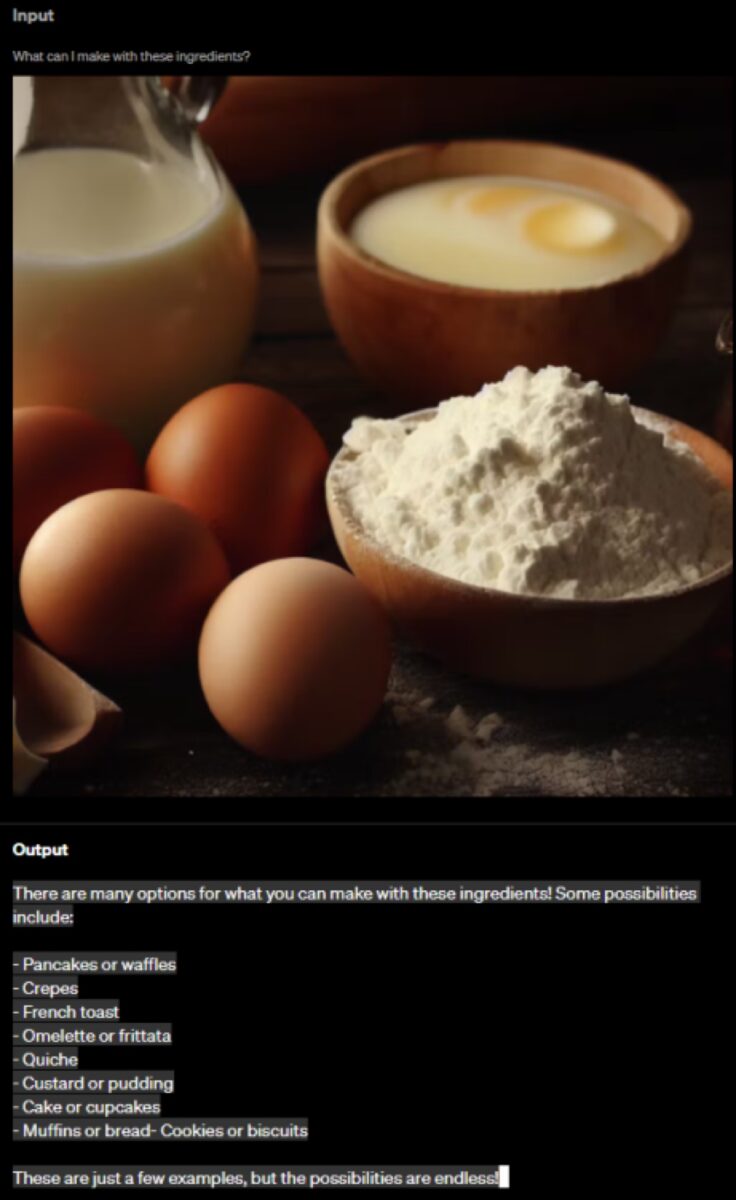

La prima differenza che salta all’occhio è che invece del solo testo, GPT-4 è anche in grado di comprendere e interpretare foto e immagini, che l’utente può sottoporre alla AI come input per domande e problemi da risolvere. Come esempio OpenAI mostra al sistema uova, farina e altri ingredienti visibili in una foto: GPT-4 riconosce ogni elemento nell’immagine e propone una serie di ricette che è possibile realizzare con quegli ingredienti.

Ma il riconoscimento di foto e immagini significa anche che ora possiamo scansionare manuali, libri, materiali di marketing, inclusi grafici e tabelle, per darli in pasto a ChatGPT basato sul nuovo modello GPT-4 per ottenere al volo sintesi, analisi e riassunti.

Tuttologo, creativo e personalizzabile

Mentre la personalità di ChatGPT prima versione era fissa per tono e stile, con GPT-4 utenti e programmatori possono configurarla a piacimento, personalizzandola in base alle proprie esigenze. OpenAI spiega che GPT-4 dispone di conoscenze molto più ampie ed è molto più accurato e anche creativo nel risolvere problemi e compiti assegnati dall’utente. Ora può imparare lo stile di scrittura dell’utente per imitarlo e scrivere canzoni.

Announcing GPT-4, a large multimodal model, with our best-ever results on capabilities and alignment: https://t.co/TwLFssyALF pic.twitter.com/lYWwPjZbSg

— OpenAI (@OpenAI) March 14, 2023

Meno allucinazioni, più secchione

Molti dei miglioramenti introdotti sono stati possibili grazie alla supervisione umana che è andata a correggere e migliorare gli errori riscontrati nella prima versione. Le cosiddette allucinazioni, errori o bug della AI, calano del 40% ma non scompaiono del tutto, mentre la probabilità di rispondere a contenuti non consentiti diminuisce dell’82%.

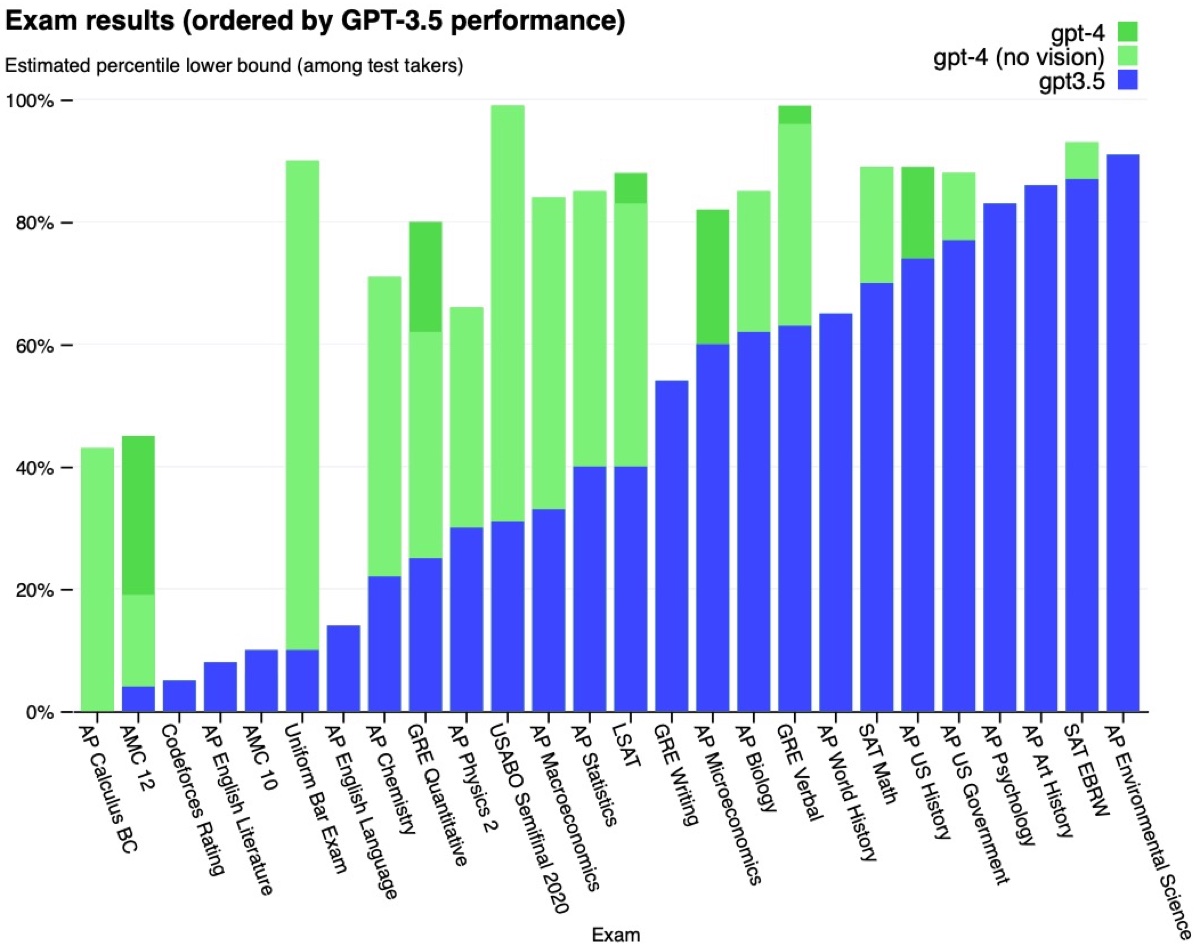

In un impressionante elenco di esami ufficiali in lingua, chimica, fisica, biologia, storia, matematica e numerose altre discipline (riportiamo un grafico di OpenAI) GPT-4 con e senza il riconoscimento delle immagini supera il modello precedente posizionandosi sempre entro i migliori 10 risultati, mentre il predecessore si piazzava sempre negli ultimi 10 risultati.

Microsoft Bing funziona già con GPT-4

Nelle ore successive all’annuncio di OpenAI, così rilevante da essere segnalato anche da Sam Altman cofondatore e CEO della società, Microsoft ha confermato che il suo motore di ricerca Bing ora funziona con il nuovo modello GPT-4. I programmatori che desiderano impiegare GPT-4 devono iscriversi in una lista di attesa: OpenAI lo mette già a disposizione degli utenti abbonanti al piano chatGPT Plus a pagamento da 20 dollari al mese.

La corsa verso l’intelligenza artificiale riserva novità quotidiane: Google rincorre e anticipa Microsoft con l’annuncio di AI in Gmail, Docs e Workspace, mentre le novità Microsoft AI per lavoro e produttività, sembra anche con IA generativa per audio e video, dovrebbero arrivare in un evento dedicato atteso per giovedì 16 marzo.

Tutti gli articoli di macitynet che parlano di Intelligenza Artificiale sono disponibili nella sezione dedicata.