Siamo tutti d’accordo che l’intelligenza artificiale sia la più grande rivoluzione verso la quale stiamo andando incontro. Forse, ed è un paradosso, mossi da una bolla speculativa che si sta gonfiando alla velocità della luce, ne sottovalutiamo la portata nell’immediato, nel breve periodo, perché le strilla e le grida dei venditori di fumo sono superiori a quello che chi tra noi è scettico vede effettivamente arrivare. Però ne sottovalutiamo anche gli effetti nel lungo periodo, perché il cambiamento c’è, ed è micidiale.

Far soldi vendendo picconi, setacci e carriole

La bolla speculativa di oggi, sia detto fra parentesi, è come tutte le bolle figlia di una doppia pratica. Da un lato è una corsa all’oro, in cui a fare i soldi – tantissimi soldi, viste le tecnologie e i moltiplicatori coinvolti – sono come al solito i fornitori di picconi, setacci e carriole: le varie Nvidia e OpenAI.

Che ha fatto tanto raccogliendo soprattutto il lavoro di Google e portandolo all’estremo, senza guardare in faccia all’etica di nessuno e anzi, giocando proprio sulla capacità di attrarre gli scienziati più bravi e mossi dalle migliori intenzioni con la foglia di fico del non-profit, che tale si è rivelata: una foglia di fico.

Ma voltiamo pagina, non guardiamo alle promesse infinite di magnifiche e progressive sorti automatiche. Non ci chiediamo quale etica ci sia dietro, quale educazione e accrescimento venga pensato per chi domani (o già stasera) si troverà ad avere il martello in mani. Già, perché questo è l’intelligenza artificiale: uno strumento, un martello. Che può essere usato per schiacciare un chiodo nella sua giusta posizione oppure per essere dato in testa al vicino di casa e al datore di lavoro (o, più probabilmente, all’impiegato).

Fare senza pensare

Questo è l’intelligenza artificiale, uno strumento straordinario, che però non pensa. E quindi, come dice il filosofo Luciano Floridi, l’intelligenza artificiale non sostituisce il nostro pensiero con il suo. L’intelligenza artificiale, dice Floridi, non pensa al posto nostro. L’intelligenza artificiale, per essere precisi, non pensa affatto.

Invece, l’intelligenza artificiale, sostiene Floridi, ci permette di agire senza pensare. Ci permette di eseguire azioni che prima avrebbero richiesto il pensiero.

La moralità dell’intelligenza artificiale

Questo, se ci riflettete un attimo, non solo è straordinario e monumentale, ma anche pericolosissimo. Fare un sorpasso in autostrada senza pensarci: farlo e basta. Sviluppare una medicina senza pensarci, svilupparla e basta. E la stessa cosa per una diagnosi, uno strumento di valutazione dell’eleggibilità per i mutui o i finanziamenti. Per la “moralità” e il “comportamento legale” del cittadino. Come sempre, considerato non colpevole sino a prova contraria. Ma non innocente, bensì non colpevole (una differenza sottile, ma tagliente)

Ecco quindi che un grande modello linguistico abbiamo capito che non pensa più di quanto pensi una calcolatrice tascabile o un computer per gli scacchi. Siamo abituati all’idea che le calcolatrici tascabili e i computer a scacchi ci risparmino lo sforzo di pensare senza essere essi stessi capaci di pensare. Non è diverso con un modello linguistico di grandi dimensioni.

Dobbiamo solo abituarci all’idea che anche la cosiddetta intelligenza artificiale, anche se usa le parole come se pensasse, non pensa. E comportarci di conseguenza, con le scelte che questo comporta.

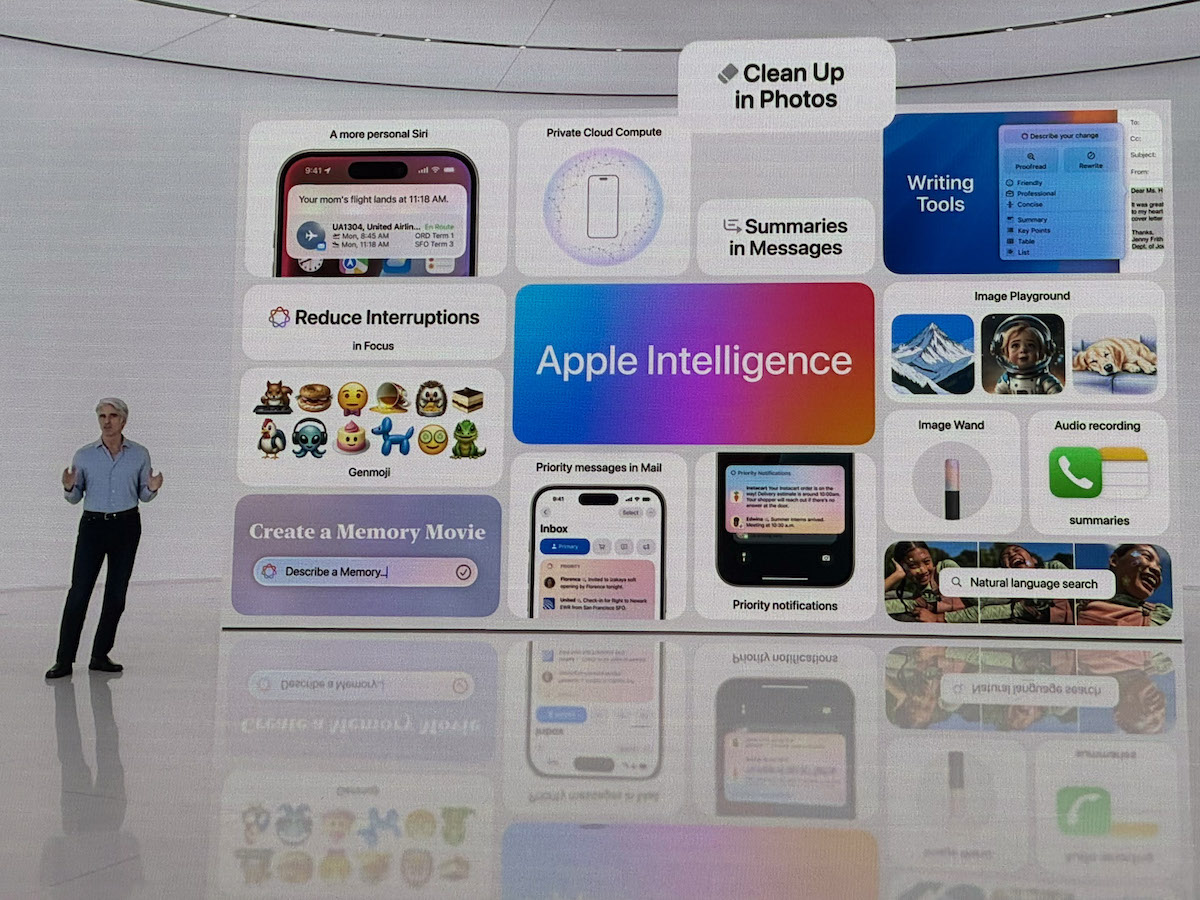

Ad esempio, come si fa con le tecnologie? L’idea di questo articolo è proprio spiegare questo passaggio. Due piccoli passaggi, anzi. Il primo è Apple Intelligence applicato alle foto, che disegna uno scenario di un certo tipo. L’altro è Recall di Microsoft, che ne disegna uno completamente diverso.

La città di Microsoft

Partiamo proprio da quest’ultimo. Recall è un hack molto furbo. Per fare in modo che l’intelligenza artificiale capisca cosa sto facendo o dove lo ho fatto, quando ho visto una determinata cosa o quando ne ho scritta un’altra, ci sono due possibili strade. Una estremamente difficile perché a grana molto fine: riuscire a far parlare decine e decine di software diversi, trovare il modo per rendere retrocompatibile il meccanismo (altrimenti alcune informazioni non emergono, rimangono nascoste) e fare tutto questo nel rispetto della privacy e degli spazi di tutti.

L’altra è entrare direttamente nella nostra testa e registrare tutto quel che vediamo e facciamo, anche le cose più rapide e momentanee. In questo modo è possibile ricercare a posteriori qualsiasi cosa ovunque sia stata mostrata sullo schermo, a prescindere all’applicazione e quindi dalla partecipazione del singolo sviluppatore.

Ovviamente Microsoft ha scelto questa seconda strada, disegnando una città ideale dove un superpotere, per il bene del prodotto, può spiare qualsiasi cosa, scattare una schermata e salvarla in un apposito database locale dove, con l’aiuto di un paio di modelli di intelligenza artificiale, decodifica il testo, riconosce le immagini e si prepara a rispondere a qualsiasi domanda dell’utente. O del malintenzionato che acquisti accesso a questo vero e proprio scrigno della conoscenza, vaso di Pandora che una volta aperto rischia di far fuggire qualsiasi contenuto possa essere visto.

E infatti Microsoft è stata coperta di improperi da una parte della rete, forse persino in maniera fin troppo non generosa ma comunque chiaramente sensibilizzata dalla privacy e dalla sicurezza, e ha dovuto fermarsi a riflettere. Che Tim Cook avesse ragione, quando sosteneva che la privacy è un diritto universale di tutti gli esseri umani?

La città di Apple

L’altra città disegnata nella sabbia del tempo è quella di Apple. Che ha sviluppato una Apple intelligence, che è stata pensata in maniera tale da non violare i diritti delle persone. Quindi, addestrata per bene, con materiali selezionati e regolarmente pagati oltre che filtrati di porcherie e orrori vari. E poi ingegnerizzate in maniera tale da non essere intrusiva o trasversale in maniera incontrollata, o rischiare di esporre all’insicurezza dei malintenzionati le informazioni delle persone.

Invece, applicandola ad esempio alle immagini contenute in Foto, l’Apple intelligence lavora per fare modifiche che siano di ripulitura e non di trasformazione radicale o, peggio ancora, di deepfake: devono infatti essere delle modifiche pensate per migliorare la qualità delle immagini, portarle a essere più vicine alle intenzioni del loro autore. Esattamente come le altre funzioni (messa a fuoco, sfocato, HDR e via dicendo) solo, più “magiche”.

Questo va dalle micro modifiche alle foto sino alla creazione di ricordi e collage che cercano di amplificare in maniera responsabile il contenuto filtrato e organizzato delle immagini nel telefono. Un sistema di strutturazione delle immagini che potrebbe essere facilmente frainteso ma che nelle intenzioni di Apple è invece pensato per cercare di arricchire i ricordi e sorprendere le persone con i bei momenti della loro vita, già registrati, avvicinando a questo lo storytelling della narrazione in tre parti (inizio, svolgimento e fine) e una musica adeguata.

In conclusione

Quello che viene fuori da questo doppio esercizio non è soltanto la perizia dei grandi programmatori presenti in tutt’e due le aziende, Apple e Microsoft. O la bontà e potenza dei modelli. Quanto le scelte etiche e l’impostazione di fondo che è stata fatta.

Microsoft ha spalmato rapidamente e in maniera assolutamente non discriminante l’intelligenza artificiale attraverso tutti i suoi prodotti e le sue funzioni, impastrocchiando tutto e rischiando di fare dei gran danni come quello di Recall, che infatti è stato “bloccato” e viene in questi giorni attentamente ripensato e riprogrammato.

Apple invece, che era ed è ben indietro dal punto di vista del tempo per mettere sul mercato i suoi prodotti di Apple intelligence (gli annunci a giugno, l’uscita chissà quando nel 2025 e forse in parte anche più in là), si è presa quel momento in più anche per pensare a cosa stava facendo a sé stessa, ai suoi prodotti e ai suoi clienti (e alle loro informazioni).

Una riflessione, quella di Apple, che da sola vale tutta la differenza che c’è tra i due ecosistemi, nonostante le aree di sovrapposizione, come ad esempio l’utilizzo massiccio di ChatGPT di OpenAI da parte di entrambe le aziende. Ma con idee, metodi, strumenti e obiettivi completamente diversi.

Stiamo entrando in un’epoca in cui le differenze saranno ancora più importanti delle similitudini e delle eguaglianze, e in cui scegliere a chi affidare i propri dati, per farli crescere, sarà sempre più importante. Vitale.