Acquistando i computer più recenti di Apple (quelli con chip M1, M2, M3 e M4 nelle varie versioni base, Pro, Max e Ultra) l’utente si imbatte in specifiche tecniche che parlano di “memoria unificata” che promette prestazioni di alto livello.

Apple ha cominciato a parlare di questa tipologia di memoria con l’introduzione del chip M1 nel 2010 ed è una tecnologia che rende possibile l’accesso a risorse di memoria (a breve a lungo termine) condivise tra tutti i componenti di elaborazione del computer.

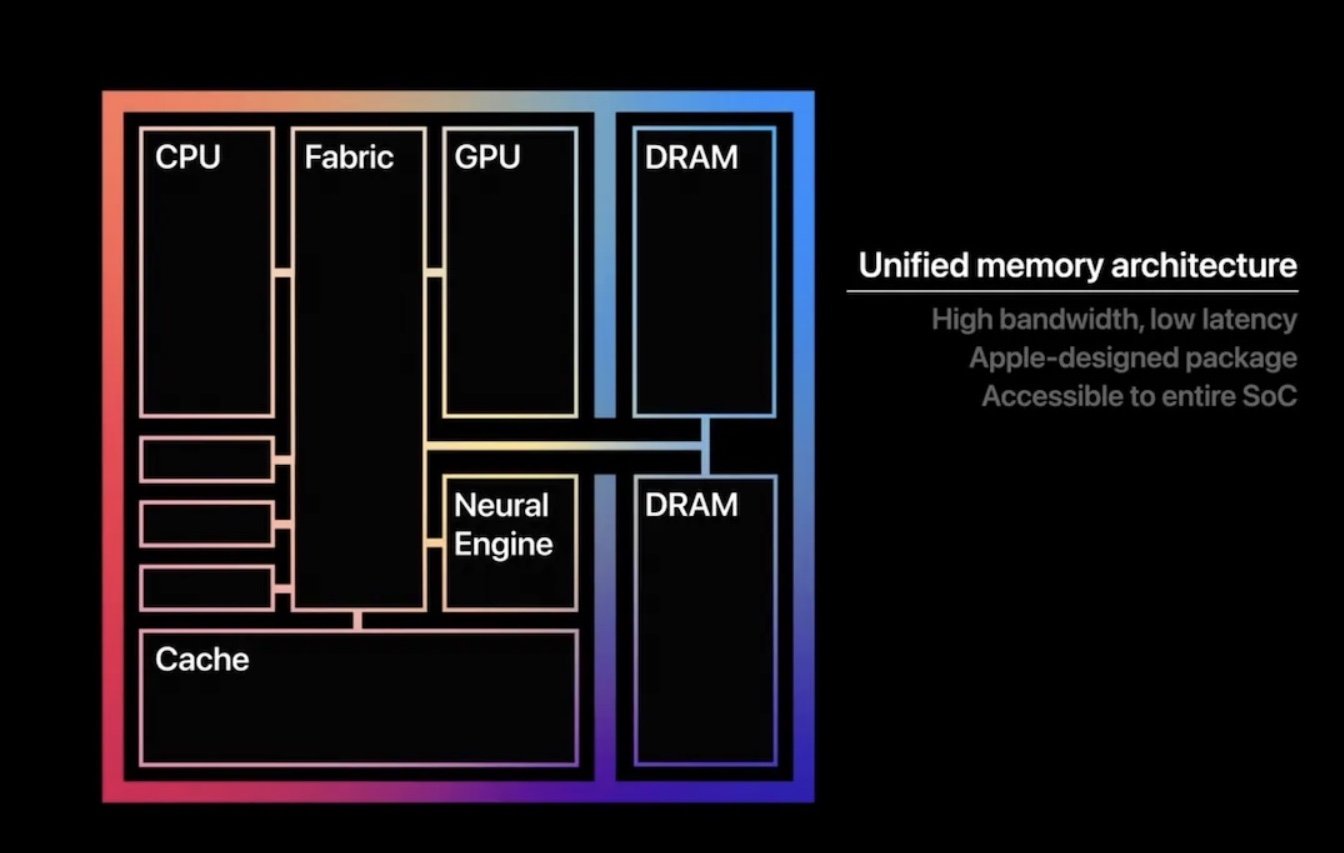

I chip, o meglio SoC, della serie Mx, sono ottimizzati per macchine e dispositivi nei quali le dimensioni contenute e l’efficienza energetica rivestono un’importanza cruciale. Questi system on a chip (SoC), racchiudono numerose tecnologie in un unico processore e presentano un’architettura di memoria che consente di vantare prestazioni ed efficienza nettamente superiore rispetto alle architetture di altri produttori.

Apple spiega che la memoria unificata “offre larghezza di banda elevata e bassa latenza in un singolo pool all’interno di un package custom., elemento che permette alle tecnologie nel SoC di accedere agli stessi dati senza spostali tra pool (raggruppamenti) di memoria, migliorando prestazioni ed efficienza rispetto ad architetture precedenti.”

A cosa serve la memoria unificata?

La memoria unificata non è una novità assoluta ma si tratta di un certo senso di un ritorno al passato, quando la RAM era costosa e i produttori preferivano condividere la memoria tra CPU (l’unità di calcolo) e GPU (l’unità dedicata alla grafica); successivamente, i produttori di schede video hanno cominciato a sfruttare memorie dedicate, più veloci rispetto alla RAM accessibile direttamente dalla CPU ma con ovvii limiti fisici legati alla distanza che il segnala deve percorrere (per comunicare da e verso GPU vera e propria e CPU).

Quella alla quale fa riferimento Apple è una evoluzione della memoria unificata, con componenti del SoC che possono avere accesso alle stesse aree, leggendo e scrivendo i dati, senza necessariamente doverli copiare e spostare. È possibile combinare RAM e la memoria dell’unità di storage in un singolo pool di memoria condiviso (un blocco di memoria assegnato a un programma, un’applicazione, a file).

Questo approccio che Apple porta avanti, è indicato come in grado di migliorare l’efficienza di elaborazione e il consumo energetico. La CPU e la GPU condividono locazioni di memoria (porzioni di celle nelle quali può essere suddivisa, a livello logico, una memoria), anziché accedere a memorie distinte per l’allocazione di RAM, VRAM e altri sottosistemi.

La larghezza di banda

La larghezza di banda dei SoC Apple varia secondo il chip; nei MacBook Air con chip M3, Apple parla di 100 GBps di “banda di memoria” (la quantità teorica di memoria gestibile al secondo); nei MacBook Pro 14″ e 16″ con chip M4 Pro e M4 Max Apple parla rispettivamente di 273GBps di banda di memoria e 546 GBps di banda di memoria; nel Mac Studio base con chip M2 Max la banda di memoria è di 400 GBps, nel Mac Studio con M2 Ultra arriva a 800 GBps di banda di memoria.

Semplificando, maggiore è la larghezza di banda, maggiore sarà la velocità di elaborazione dei dati in memoria o in background che tiene occupato il SoC dietro le quinte, sottraendo energia alla CPU e consumando memoria.

Con l’arrivo del chip M4, Apple ha utilizzando la tecnologia a 3 nanometri di seconda generazione, facendo compiere a questi chip un ulteriore salto in avanti rispetto alle prestazioni per watt del chip M3, non solo in termini di CPU e GPU, con migliorie sulla banda di memoria in più rispetto a M3″ che permettono a questi SoC di gestire carichi di lavoro ancora più grandi e complessi. Con M4 Max la memoria unificata arriva fino a 128GB, il doppio rispetto al chip M1 Max.

Anche la GPU è in grado di trarre vantaggio della memoria unificata. Rispetto alle schede grafiche per PC più potenti sul mercato che offrono anche decine di GB, i chip M1 e M2 Ultra possono sfruttare quantità di memoria grafica anche elevatissime, con ovvii benefici per le attività che richiedono geometrie 3D estreme e il rendering di scene imponenti.

Dynamic Caching e accelerazione hardware

I chip Apple Silicon a partire da M3 vantano GPU con una tecnologia denominata Dynamic Caching, nuove funzioni di rendering come mesh shading e ray tracing con accelerazione hardware.

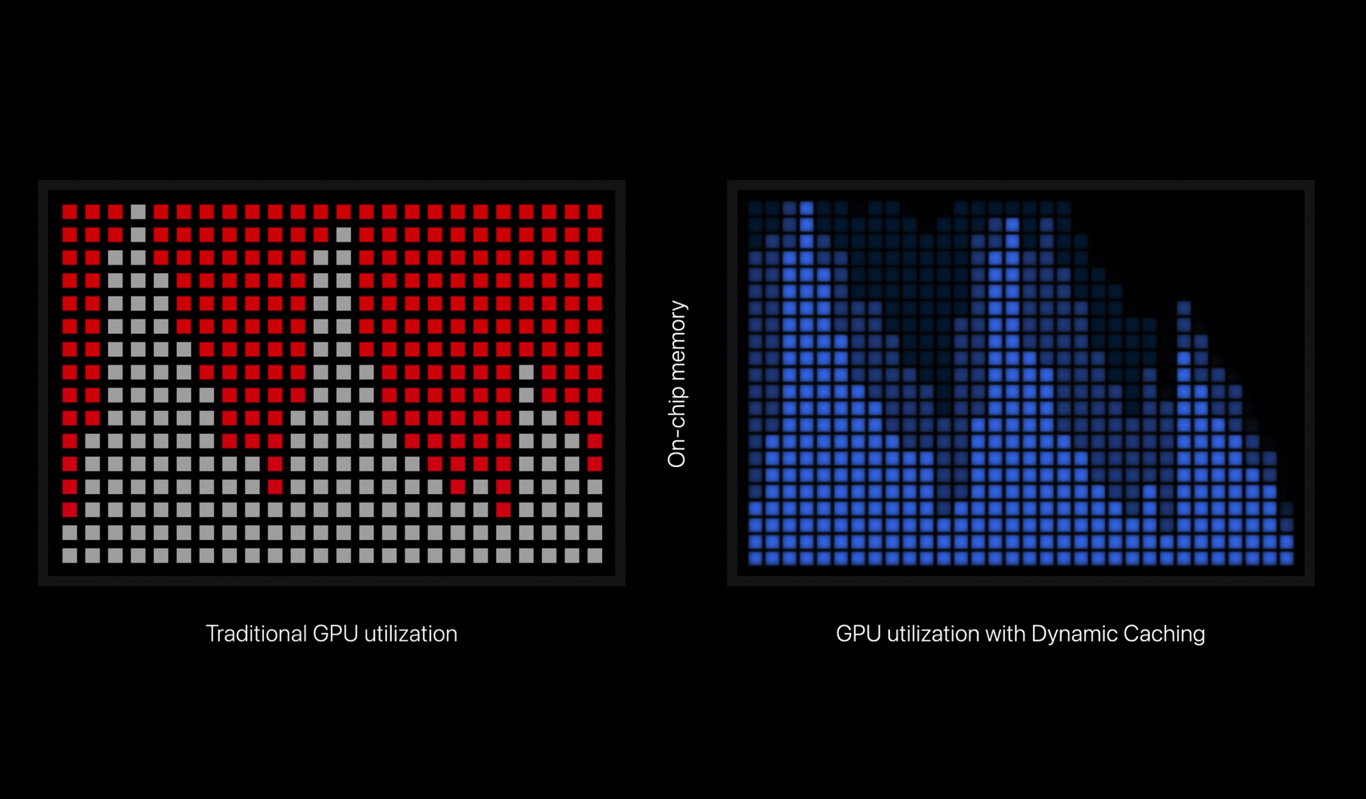

La tecnologia Dynamic Caching alla quale abbiamo accennato sopra, consente di allocare in tempo reale l’uso della memoria locale nell’hardware; in pratica per ogni attività viene usato solo il quantitativo di memoria necessario. L’uso della GPU è estremamente ottimizzato, e questo si traduce in performance migliori per le app e giochi più complessi.

La concorrenza

Un approccio simile a quello della memoria unificata di Apple è stato sfruttato da Nvidia con CUDA 6, piattaforma di elaborazione e programmazione in parallelo che non richiede la copia delle operazioni in memorie diverse ma offre un sistema di memoria unificata sopra la struttura (i programmatori possono operare sui contenuti senza prima esplicitamente copiarli nella memoria, sfruttando un puntatore condiviso).

Di questo approccio sentiremo parlare sempre più: dal punto di vista dei programmatori è un toccasana che permette di velocizzare il lavoro; alcuni produttori di SoC propongono architetture ibride, con core ARM e core grafico integrati, scelta che permette di sgravare il processore da vari compiti, eseguendo più velocemente varie operazioni e consumando meno.

Apple sfrutta anche la memoria di archiviazione?

Quando necessario, Apple sfrutta nei suoi sistemi (Mac e iPad) la memoria destinata all’archiviazione come memoria virtuale; la grande velocità di quest’ultime memorie può essere sfruttata per la gestione dei dati, nei casi nei quali non è richiesta una latenza minima (tipicamente per la memorizzazione temporanea durante l’esecuzione di determinate applicazioni).

Quando necessario, l’unità di archiviazione può essere sfruttata dal sistema operativo come parte del pool di memoria, un sistema che rende inutili i confronti con le vecchie macchine con processori Intel sulle quali memoria RAM e unità SSD lavorano in modo diverso.

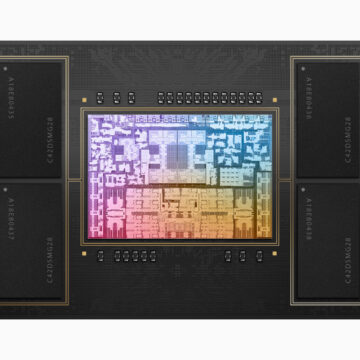

Ultrafusion su Apple Silicon M1 e M2 Ultra, aspettando M4 Ultra

Dal punto di vista tecnico, Apple spiega che l’architettura di packaging “UltraFusion“, sfruttata per interconnettere il die di due chip M1 Max, utilizza un interposer (interfaccia elettronica) di silicio che connette i chip su oltre 10.000 segnali, offrendo un’impressionante larghezza di banda inter-processore da 2,5TB/s a bassa latenza, oltre quattro volte superiore rispetto alla larghezza di banda di altre tecnologie di interconnessione multi-chip; ciò consente a M1 ed M2 Ultra di comportarsi e di essere identificato dal software come un unico chip, con ovvii vantaggi in flussi di lavoro particolarmente pesanti e complessi.

Vedremo prossimamente se Apple utilizzerà tale tecnologia su un M4 Ultra prossimo venturo.

Di quanta memoria unificata ho bisogno?

La maggiore efficienza, la comunicazione diretta, il risparmio energetico sono vantaggi enormi ma le regole d’oro per la scelta di un Mac rimangono le stesse: i modelli da 8 GB sono buoni per navigazione, word processor e uso standard, i modelli da 16 GB funzionano meglio con PhotoShop e video editing o 3D di base ma se utilizzate enormi librerie audio, video 4K e 8K con tantissimi layer o dovete gestire un complesso sistema di intelligenza artificiale dovete salire anche nelle dimensioni della RAM. Di questo parleremo in dettaglio nella nostra guida d’acquisto al Mac di fine 2024 / inizio 2025.

![iGuide per i regali di Natale - macitynet..ti CTA Natale iGuida [per Settimio] - macitynet.it](https://www.macitynet.it/wp-content/uploads/2025/12/regali-di-natale-consigli-di-macitynet.jpg)