In passato varie realtà quali Facebook, Nvidia e alcune startup hanno provato a creare sistemi in grado di convertire oggetti 2D in 3D ma in una pubblicazione su arXiv (archivio per bozze definitive di articoli scientifici), un team proveniente da Microsoft Research riferisce di un framework nel quale si parla della prima tecnica “scalabile” di addestramento per modelli 3D partendo da dati 2D.

A detta del team di ricerca (qui i dettagli in PDF), il sistema è in grado di apprendere costantemente a generare figure migliori di quelle che è possibile ottenere da esistenti modelli addestrati partendo soltanto da immagini 2D, risultato che potrebbe essere una manna dal cielo per sviluppatori di videogiochi, attività di e-commerce e studi di animazione che non hanno mezzi o competenze per creare figure 3D da zero.

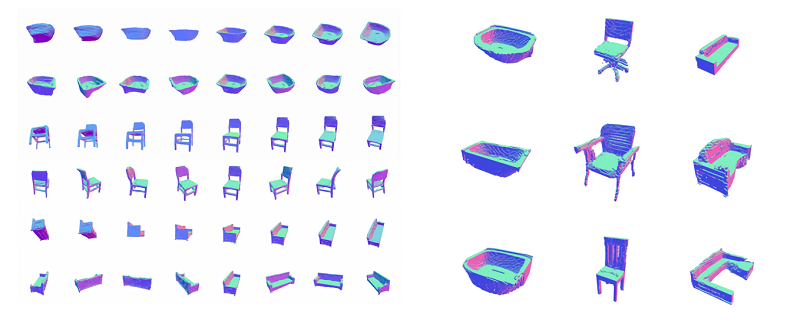

Rispetto ad altri sistemi già visti in passato, i ricercatori che hanno ideato il nuovo sistema hanno addestrativo il modello generativo per le forme 3D partendo da vettori di input casuali per generare voxel (valori in una griglia 3D), alimentanti con un procedimento di rendering definito non differenziabile usando sistemi di rendering standard (Pyrender, basato su OpenGL).

Tecnicismi a parte, i ricercatori riferiscono che il sistema è in grado di sfruttare luci e ombre delle immagini, estrarre informazioni significative ed è in grado di produrre campioni realistici quando è addestrato con dataset di immagini naturali. “Il nostro approccio individua efficacemente la struttura interna di oggetti concavi tenendo conto delle differenze nell’illuminazione tra superfici”, scrive uno dei coautori della ricerca, “permettendo di acquisire con precisione concavità e spazi vuoti”. In futuro è previsto il lavoro su colori, materiali e luci, permettendo di estendere il funzionamento con un più generico dataset di immagini del mondo reale.

Per tutti gli articoli di macitynet che parlano di Intelligenza Artificiale fate riferimento a questo indirizzo.