Con l’arrivo dei nuovi iPhone 13 (qui la recensione di macitynet di iPhone 13 Pro) Apple sospende la sua proverbiale riservatezza per mettere in luce caratteristiche, funzioni e dettagli di una delle novità più importanti e apprezzate in assoluto dei nuovi terminali: le fotocamere degli iPhone di ultima generazione, come già fatto per esempio per la spettacolare modalità Cinema di cui abbiamo riferito in questo articolo.

Tra le chicche più interessanti in assoluto il fatto che ingegneri e dirigenti Apple inizino a progettare hardware, specifiche e funzioni delle fotocamere iPhone circa tre anni prima rispetto alla disponibilità sul mercato e per gli utenti. Questo significa che quello che oggi usiamo sugli iPhone 13 è stato immaginato e progettato a Cupertino nel 2018.

La spiegazione arriva da un articolo di GQ Magazine grazie all’intervista di due dirigenti Apple: Jon McCormack Vice President camera software engineering e da Graham Townsend, Vice President camera hardware engineering intevistati da GQ. «La pianificazione deve iniziare circa tre anni prima, perché è allora che fissiamo effettivamente le specifiche del silicio» dichiara Graham Townsend, Vice President camera hardware engineering.

«Quindi, ad esempio, il sensore viene definito a quel punto e anche il processore A15 Bionic è congelato [definito, ndr]. È allora che dobbiamo iniziare a parlare con Jon e prevedere le esperienze che vogliamo. Ovviamente quando abbiamo progettato il nuovo obiettivo ultragrandangolare, avevamo intenzione di fornire foto macro. Ma come funzionerà sia nelle foto che nei video?».

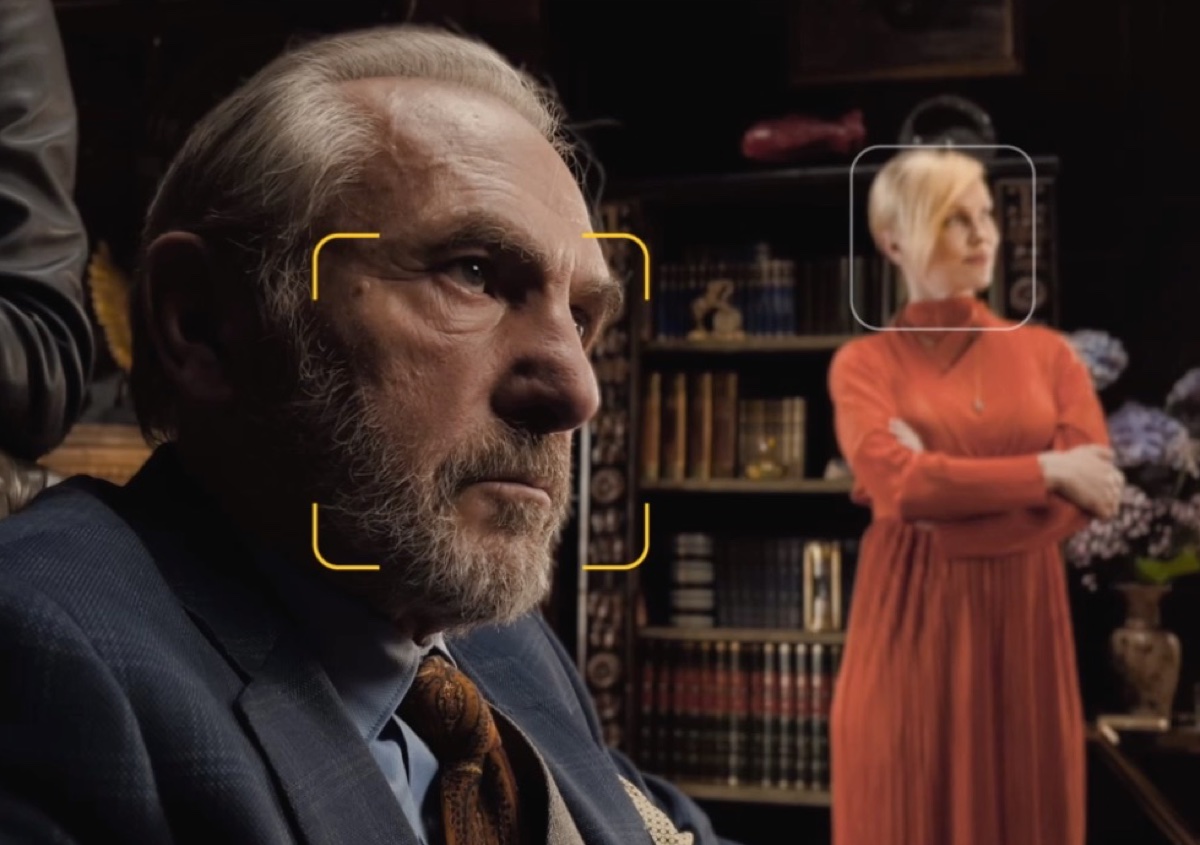

Tutti e quattro i modelli di iPhone 13 sono dotati della nuova modalità Cinema che permette agli utenti di registrare video con profondità di campo ridotta e cambi di messa a fuoco automatici tra i soggetti. McCormackoffre ulteriori dettagli sullo sviluppo interno di questa funzione e le sfide che sono state affrontate.

«È stato un processo lungo con molte strade tortuose, ma come la maggior parte delle cose profonde ci vuole un po’ di tempo» dichiara McCormack. «Non stiamo solo osservando la profondità di ogni singolo fotogramma, ma c’è anche questa cosa chiamata stabilità temporale: mentre ci muoviamo tra i fotogrammi con le persone che si muovono, come possiamo assicurarci che non finiscano con bordi strani e cose come questa?».

I due dirigenti intervistati parlano anche di responsabilità ambientale e dell’impegno di Apple su tutti i fronti in questo campo. In questo articolo ci atteniamo al comparto fotocamere degli iPhone: i due dirigenti sottolineano l’impegno di Cupertino per rendere l’esperienza utente sempre il più semplice possibile.

«Molto prima ancora di premere l’otturatore, basta sollevare la fotocamera, stiamo esaminando l’esposizione automatica, il bilanciamento del bianco, l’autofocus per assicurarci di ottenere tutte le informazioni giuste, le informazioni grezze catturate» dichiara Jon McCormack.

In questo articolo la recensione di iPhone 13 Pro di macitynet.