Tra le funzionalità offerte da Apple Intelligence (l’IA della Mela che in Italia vedremo da aprile), ci sono le “notifiche prioritarie“, in grado di mostrare le informazioni più importanti e riassunti delle notifiche.

Le Priority Notifications appaiono in cima alla raccolta, per portare in evidenza le più importanti, con riepiloghi che aiutano l’utente a farsi un’idea dei messaggi più lunghi o delle chat di gruppo particolarmente attive, direttamente dalla schermata di blocco.

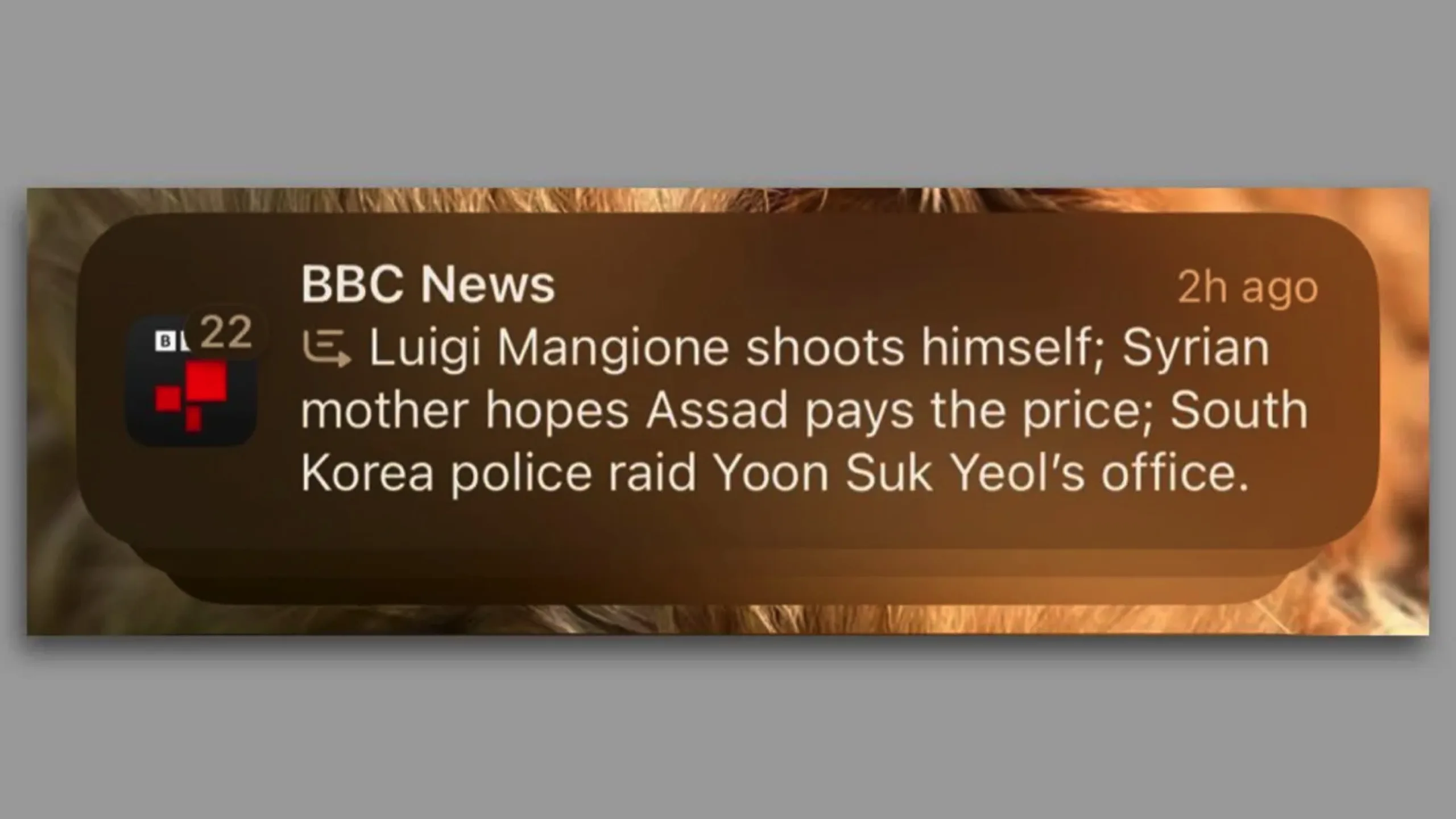

La funzione che crea riepiloghi è al centro di un problema che si è verificato con la BBC. Venerdi 13 dicembre l’IA di Apple ha riassunto in modo errato una notizia segnalata in un articolo della BBC.

L’editore radiotelevisivo britannico si è lamentato con Apple per come è stata sintetizzata una notizia, mostrando indicazioni completamente errate.

Un riassunto della notifica di una notizia della BBC indicava “Luigi Mangione shoots himself” (Luigi Mangione si è sparato), in riferimento all’uomo arrestato pochi giorni addietro, incriminato per l’uccisione dell’amministratore delegato di UnitedHealthcare.

Da come l’IA di Apple ha riassunto la notizia, sembrava che l’uomo si fosse suicidato ma non è così: si tratta di quelle che in gergo si chiamano “allucinazioni”, situazioni in cui un sistema di intelligenza artificiale produce risultati che non sono basati sulla realtà o sulla verità oggettiva, un fenomeno che può verificarsi con vari tipi di sistemi di intelligenza artificiale, compresi quelli basati su reti neurali artificiali e algoritmi di apprendimento automatico.

La BBC non ha gradito quanto accaduto e se altri avrebbero fatto passare la cosa, ha preferito lamentarsi apertamente con Apple: “La BBC è il mezzo di informazione più riconosciuto al mondo per la sua affidabilità. È essenziale che il nostro pubblico possa fidarsi di qualsiasi informazione o articolo pubblicato per nostro conto, e questo include le notifiche”.

A quanto pare non è la prima volta che succede qualcosa del genere e anche il New York Times ha segnalato errori in una notifica per riassumere tre articoli, riportando “Benyamin Netanyahu è stato arrestato”, notizia non vera (la Corte penale internazionale ha emesso un mandato di arresto ma Netanyahu non è stato arrestato).

Quando accaduto dimostra ancora una volta la fragilità delle AI in generale pochi mesi addietro l’IA di Google suggeriva di mangiare delle rocce di tanto in tanto per digerire meglio, oppure di mettere la colla sulla pizza per tenere meglio legati insieme i vari ingredienti.

Tutti gli articoli che parlano di Intelligenza Artificiale sono nella sezione dedicata di macitynet.