Le imprese appaltatrici che lavorano con Apple su una tecnologia come Siri, ascoltano regolarmente le conversazioni tra gli utenti e l’assistente vocale. Lo riferisce The Guardian spiegando che tra le conversazioni che i dipendenti hanno avuto modo di ascoltare non mancano riferimenti a traffici di droga, informazioni mediche, coppie che fanno sesso, elementi che sono parte del lavoro di chi ascolta per fornire un controllo di qualità, o una “classificazione” per l’assistente vocale.

“Apple non lo menziona esplicitamente nella sua documentazione per la privacy rivolta al consumatore”, riferisce il quotidiano britannico, “ma una piccola porzione di registrazioni delle conversazioni che avvengono con Siri viene passata a committenti che lavorano per l’azienda in giro per il mondo”. Questi hanno il compito di valutare le risposte tenendo conto di una varietà di fattori, compresa la possibilità che l’assistente vocale sia stato attivato per errore, se la domanda poteva essere qualcosa alla quale Siri poteva rispondere e se l’eventuale risposta di Siri è stata appropriata.

Apple riferisce che i dati in questione sono usati per migliorare Siri, le funzionalità di dettatura, comprendere meglio l’utente e riconoscere ciò che quest’ultimo pronuncia. Quello che Apple non dice, riferisce il Guardian, è che alcune conversazioni sono riprodotte da essere umani che ascoltano registrazioni pseudoanonime.

Al giornale britannico, Apple ha spiegato: “Una piccola porzione delle richieste a Siri viene analizzata per migliorare Siri e le funzioni di dettatura. Le richieste degli utenti non sono associate con l’Apple ID. Le risposte di Siri sono analizzate in strutture sicure e tutti i revisori hanno l’obbligo di attenersi a rigorose disposizioni di riservatezza di Apple. La Mela riferisce che solo un piccolissimo subset di conversazioni giornaliere con Siri, meno dell’1%, viene sfruttato per le classificazioni, e quelli usati sono spezzoni tipicamente di pochi secondi.

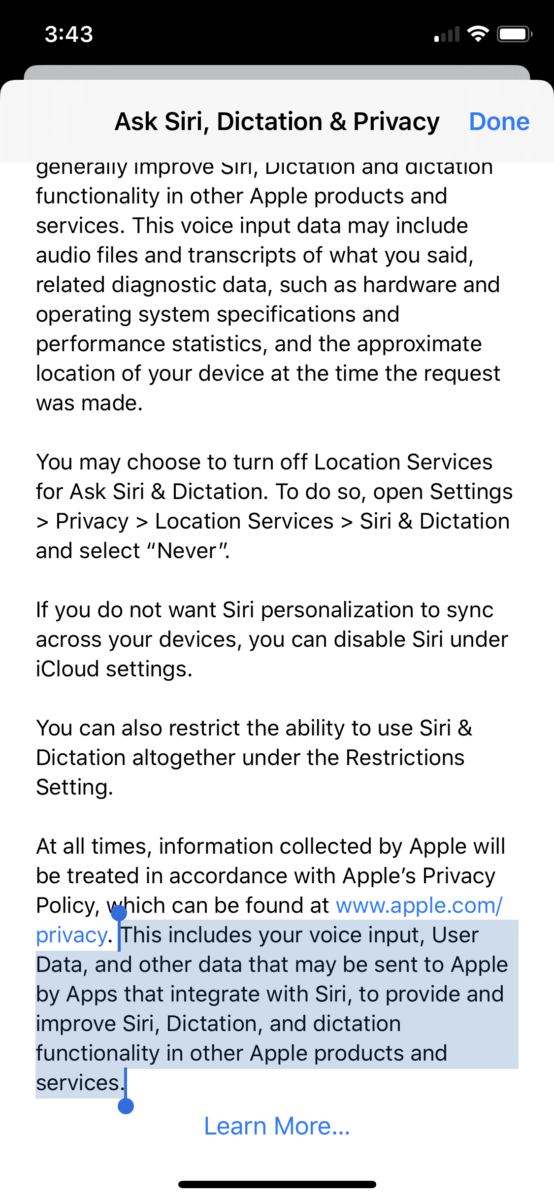

Non è ad ogni modo vero che Apple non spiega l’utilizzo delle registrazioni con Siri. Il sito 9to5Mac fa notare che l’invio di registrazioni vocali per effettuare analisi sulla voce è esplicitamente citato negli avvisi legali che è possibile leggere da iOS.

Un informatore che preferisce rimanere anonimo e che lavora per Apple riferisce di preoccupazioni in merito all’attivazione di Siri per errore, spiegano che non sono mancate volte nelle quali è stato possibile ascoltare conversazioni private tra medici e pazienti, accordi commerciali, condotte criminali, rapporti sessuali e così via, registrazioni accompagnate da elementi relativi alla localizzazione, contatti e altri dati, partite da utenti che per errore hanno attivato Siri.

Pochi giorni addietro ha fatto molto discutere la scoperta che non solo Amazon con Alexa ma anche Google ha dipendenti il cui scopo è ascoltare le conversazioni con gli assistenti vocali, trascrivendo le richieste. Big G avrebbe incaricato appaltatori indipendenti in varie parti del mondo con il compito di ascoltare e trascrivere le conversazioni audio, allo scopo di migliorare la tecnologia. Un portavoce di Google ha confermato il tutto, spiegando, sulla falsariga di quanto fa anche Apple, che i suoi esperti di linguaggio trascrivono “un piccolo set di richieste”- circa lo 0.2% dei frammenti audio – e che questo lavoro è “fondamentale” per lo sviluppo di tecnologie alla base di prodotti come Google Assistant.