OpenAI ha interrotto l’accesso alle sue API (per creare applicazioni AI) a un ingegnere che si firma con lo pseudonimo sts_3d, il cui video di un fucile motorizzato, controllato tramite comandi vocali alimentati da ChatGPT ha suscitato preoccupazioni online.

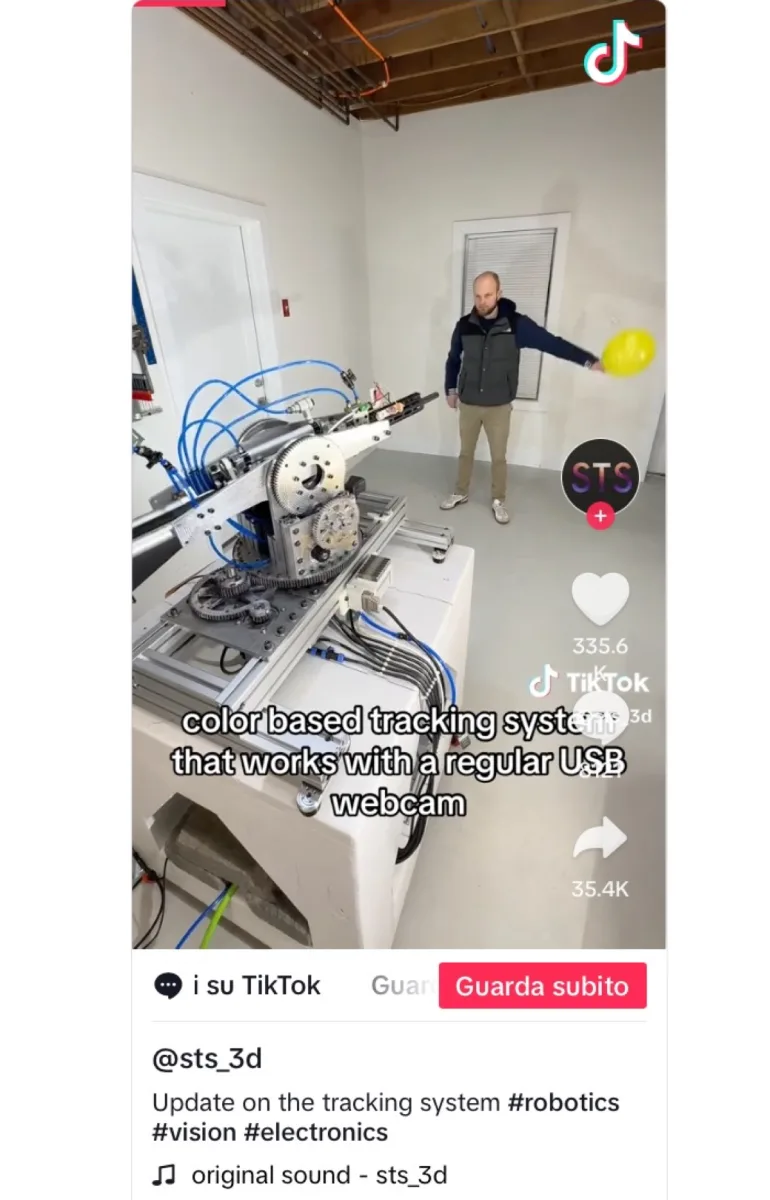

Il progetto, inizialmente una sedia girevole motorizzata, è stato poi modificato per integrare un sistema di mira automatizzato e un servomeccanismo per sparare proiettili. Sebbene quella mostrata in video sia solo una simulazione, il progetto non è ovviamente piaciuto al team di OpenAI.

L’integrazione con le API di OpenAI, infatti, consentiva all’ingegnere di impartire comandi vocali, come “mirare” e “sparare”, con risposte sintetizzate da ChatGPT. Dopo aver completato un’azione, il sistema rispondeva in modo allegro, come nel caso di un comando seguito dalla frase: “Sono felice di essere stato d’aiuto!”.

La risposta di OpenAI

In una dichiarazione ufficiale, OpenAI ha spiegato di aver identificato e bloccato il progetto del fucile AI prima ancora della segnalazione, affermando che le sue politiche vietano l’uso delle sue tecnologie per sviluppare armi o sistemi che possano compromettere la sicurezza. La questione ha comunque evidenziato il rischio legato all’uso improprio dell’intelligenza artificiale, soprattutto in contesti particolari, come quello degli armamenti.

Nonostante la viralità del video su TikTok, il progetto di sts_3d non rappresenta un’arma autonoma rivoluzionaria. I comandi vocali risultano lenti rispetto ad altre tecnologie simili, come i sistemi che tracciano oggetti in tempo reale. Tali progetti esistono già da anni, indipendentemente dall’ascesa di modelli linguistici come ChatGPT.

Dunque, nonostante il clamore suscitato, connesso alle preoccupazioni di una AI armata, in realtà il video mostra una tecnologia che esisteva già e che risulta, per quanto strano a dirsi, meno pericolosa di altri sistemi di armamenti più reattivi e precisi.

E’ certo, però, che un ipotetico legame tra AI e armi alimenta paure di sistemi autonomi capaci di agire senza intervento umano. Sebbene OpenAI mantenga restrizioni sull’uso delle sue tecnologie, la proliferazione di modelli Open Source rende inevitabile la sperimentazione di sistemi d’arma completamente autonomi. La sfida, allora, sarà quella di gestire eticamente e legalmente queste innovazioni per evitare conseguenze pericolose.

Tutte le notizie che parlano di Intelligenza Artificiale sono nella sezione dedicata di macitynet.