Capacità di capire quel che vogliamo, quella di lavorare per noi, di gestire i nostri contenuti e di renderli migliori preservando la nostra privacy e facendo a noi decidere il modo di sfruttarla. Potremmo dire che in sostanza è tutto questo Apple Intelligence, l’interpretazione Apple dell’Intelligenza Artificiale, ma in realtà è qualche cosa di molto più complesso, strutturato, pervasivo e dire in una frase che cosa fa e a che cosa serve è sostanzialmente impossibile.

Apple stessa ci prova e non va segno quando, dopo averci detto nell’attacco dei suoi comunicati che «Apple Intelligence è il sistema di intelligenza personale per iPhone, iPad e Mac che unisce la potenza dei modelli generativi al contesto specifico dell’utente per offrire un’intelligenza altamente utile e pertinente» aggiunge a seguire quasi 20mila battute di testo.

Dove troviamo l’Intelligenza Artificiale di Apple?

Del resto fare di meglio sarebbe molto complicato. Apple Intelligence è infatti ovunque essendo profondamente integrato in iOS 18, iPadOS 18 e macOS Sequoia.

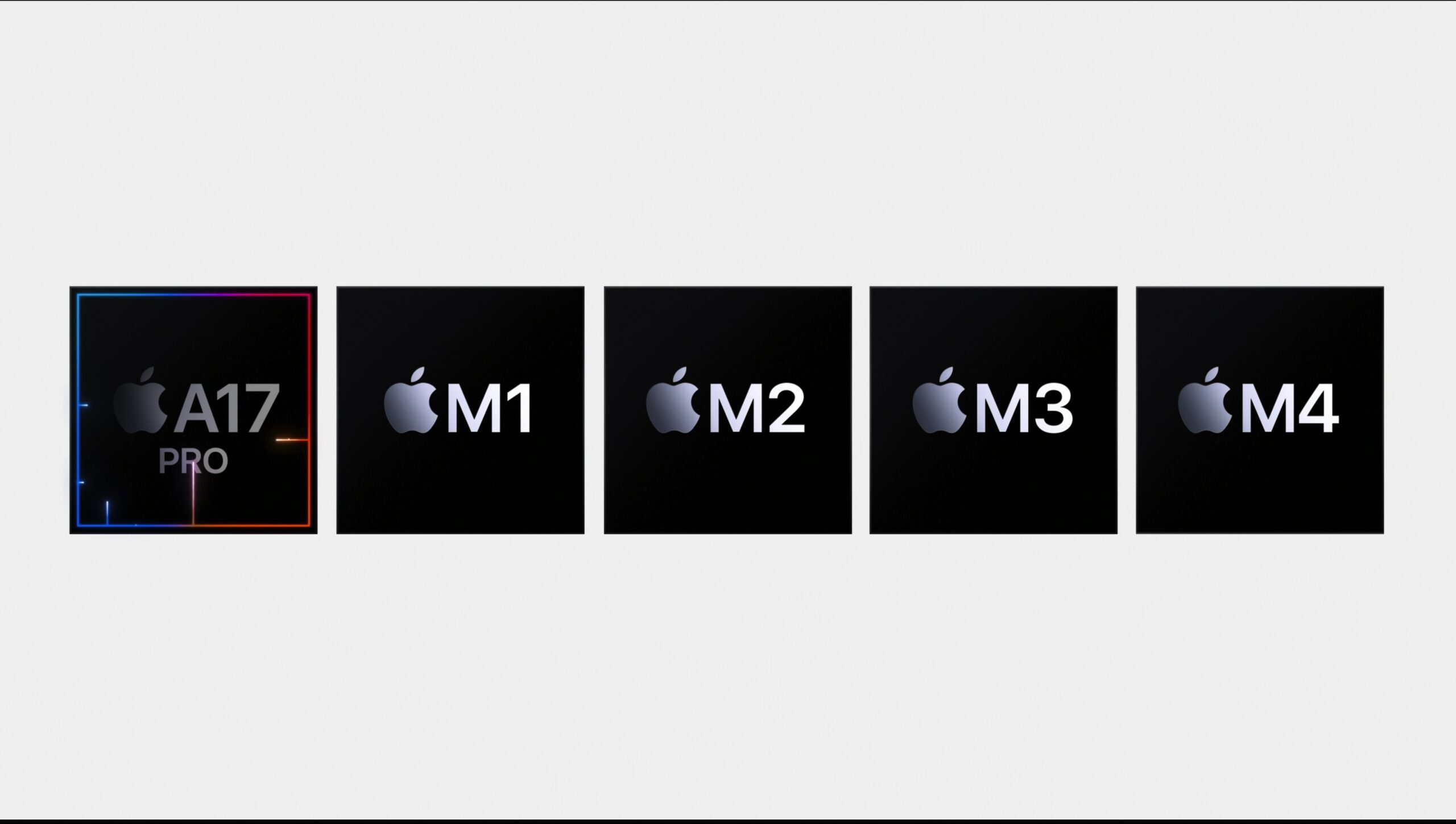

A gestire l’Ai sono i processori più avanzati di Apple: A17 e tutti i cosiddetti Apple Silicon, da M1 in su a quali viene conferito il compito di «comprendere e creare linguaggio e immagini, eseguire azioni nelle app e attingere dal contesto personale per semplificare e velocizzare le attività di tutti i giorni».

Apple Intelligence, infatti, opera in gran parte direttamente on device, come noto. E anche se una parte, i task più inensivi, si affida al calcolo da server (in un processo che viene definito Private Cloud Compute), è il processore locale ad occuparsi di darci le risposte più immediate.

Questo finisce per dare solo ai dispositivi più recenti la capacità di gestirla ma anche «un sistema totalmente sicuro e privato – dice Tim Cook – che riesce ad aiutare le persone a fare le cose che stanno loro più a cuore. Questa è AI come solo Apple può offrirla, e non vediamo l’ora che gli utenti scoprano cosa è in grado di fare».

I Writing Tools: la scrittura migliorata

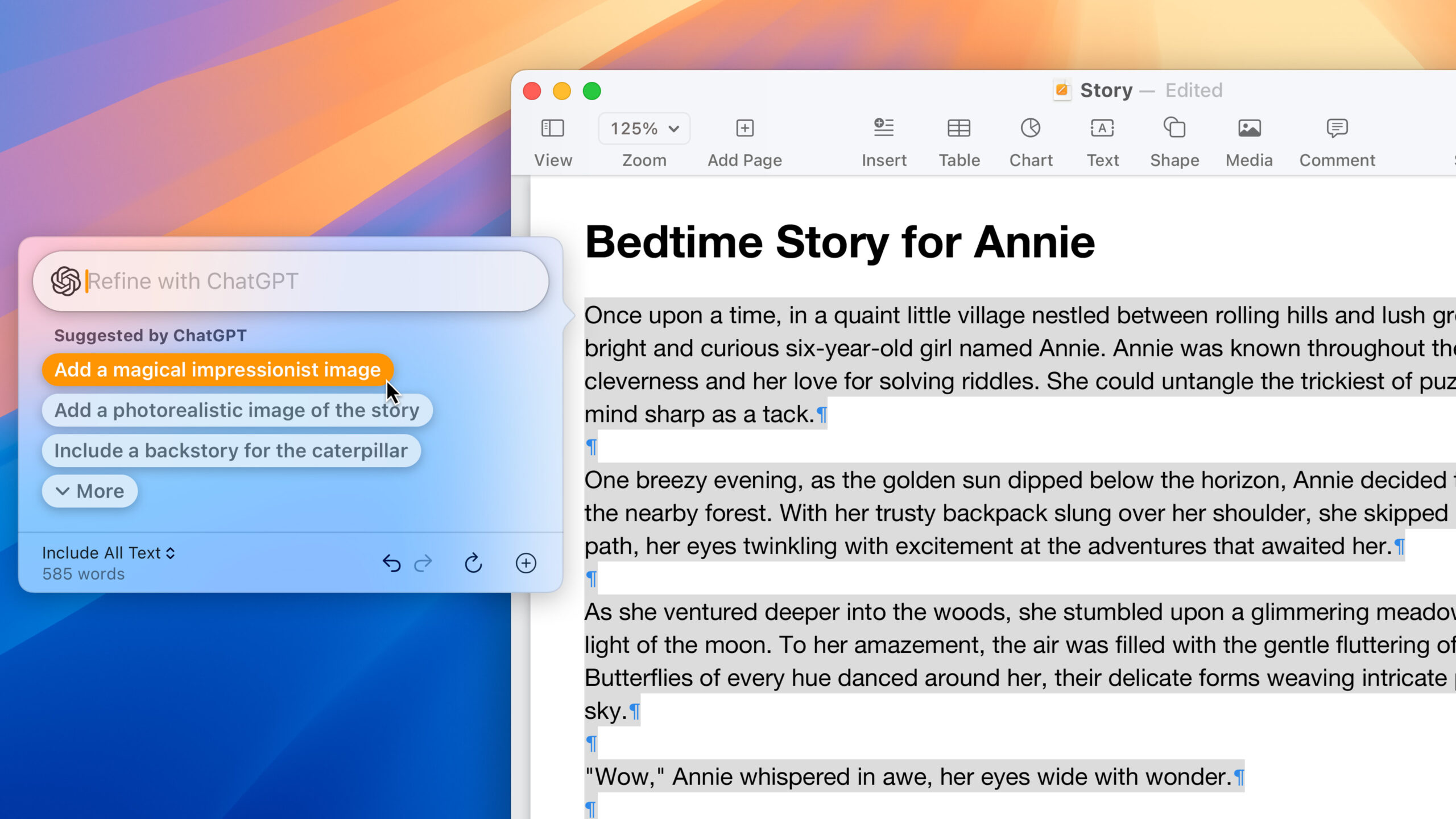

Abbiamo detto che l’Ai Apple aiuta a far le cose meglio. E questo a cominciare dalla scrittura grazie a quelli che Apple definisce i Writing Tools grazie ai quali l’utente può rielaborare, revisionare e sintetizzare un testo.

I Writing Tools permettono ad esempio, ci dice Apple, di riorganizzare gli appunti di una lezione, rivedere la forma di un blog post o verificare che un’email sia scritta nel migliore dei modi.

Nel corso del keynote abbiamo visto in azione la funzione Rewrite che presenta varie versioni del testo che abbiamo scritto, consentendo di scegliere quella che riterremo migliore per il contesto e le finalità del messaggio.

Ci sono a disposizione anche Proofread una funzione che controlla grammatica e sintassi, suggerendo le modifiche (e spiegando perchè vengono suggerite) e Summarize che «permette di sintetizzare – dice Apple – un passaggio di testo e visualizzarlo sotto forma di paragrafo discorsivo, lista di concetti principali, tabella o elenco».

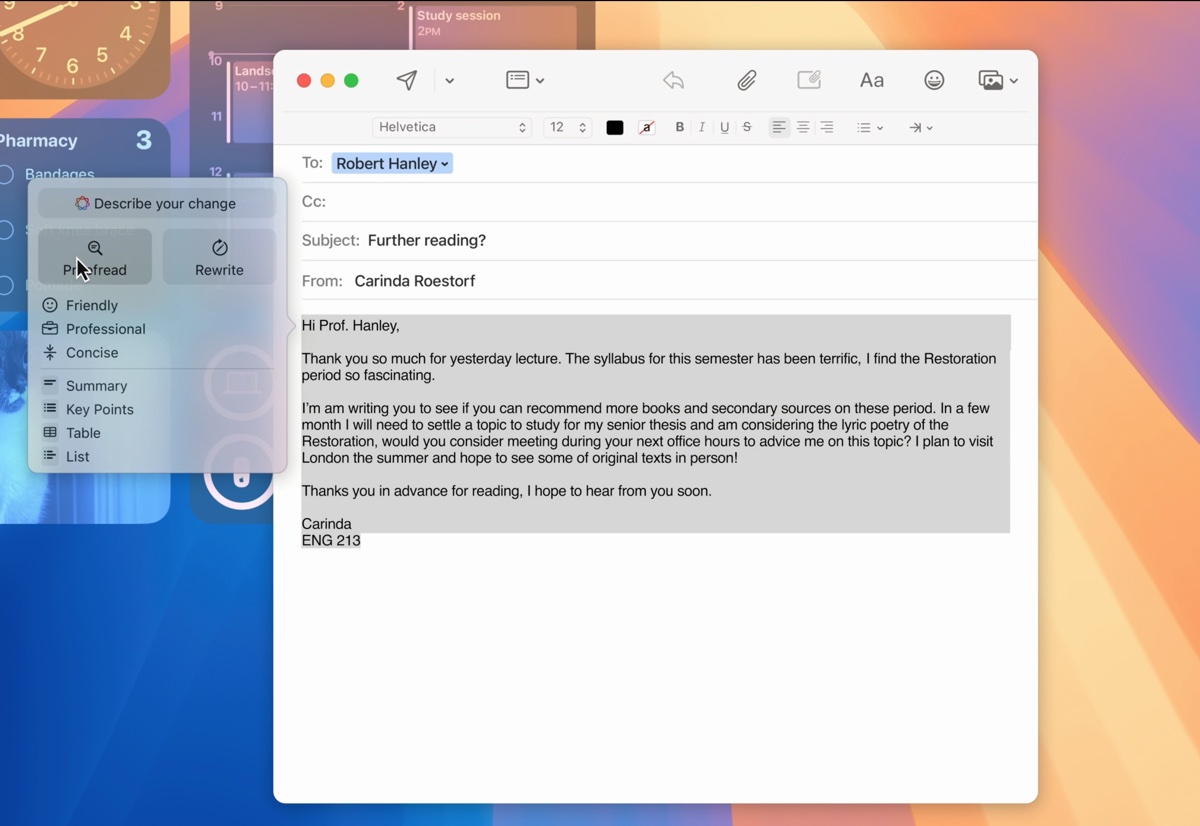

Mail diventa il nostro segretario

Mail sfrutta Apple Intelligence per riordinare i messaggi secondo la loro importanza in base al momento (Priority Messages ) e ne crea anche una sintesi così che anziché vedere soltanto le prime righe dell’email un riassunto.

Se poi vorremo rispondere entrerà on azione Smart Reply che offre suggerimenti per le risposte rapide e identifica le domande nelle email per garantire che l’utente non ne perda nessuna.

Prima le notifiche più importanti

Apple Intelligence si applica anche alle notifiche: le Priority Notifications appaiono in cima alla raccolta, per portare in evidenza le più importanti, e i riepiloghi aiutano l’utente a farsi un’idea dei messaggi più lunghi o delle chat di gruppo particolarmente attive direttamente dalla schermata di blocco.

Il sistema è anche in grado di comprendere quali notifiche sono meritevoli di superare il blocco di full immersion che ha una modalità che si chiama Reduce Interruptions, che mostra solo le notifiche che potrebbero richiedere l’attenzione immediata dell’utente, per esempio, andare a prendere in anticipo i piccoli all’asilo, nell’esempio di Apple.

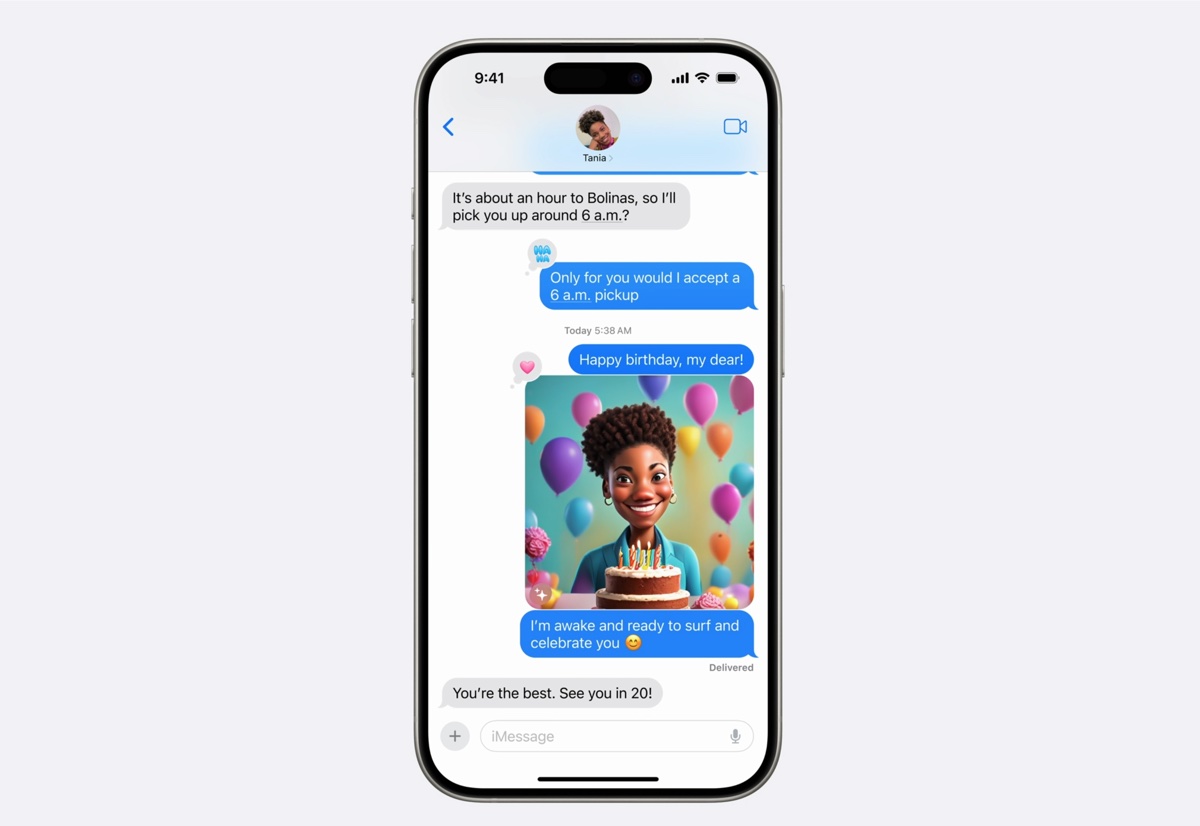

Image Playground, espressione per immagini

Apple Intelligence come i migliori sistemi di intelligenza artificiale è in grado di creare con Image Playground immagini ma in maniera differente da tutto il resto e anche più creativamente.

Le immagini vengono generate per essere usate nelle conversazioni per esprimersi in modi nuovi e divertenti ad esempio in Messaggi, ma è anche disponibile come app a sé stante.

Si può scegliere fra categorie, temi, costumi, accessori e luoghi, inserire una didascalia per le immagini, selezionare una persona dalle foto nella libreria personale e aggiungerla a un’immagine, e scegliere lo stile che preferisce.

La bacchetta magica ed Apple Pencil

In Note, Keynote, Freeform e Pages e in altre app che useranno il nuovo framework Playground, si può accedere a Image Playground attraverso la nuova bacchetta magica, Image Wand, che appare nella palette di strumenti di Apple Pencil. Apple Intelligence interpreta gli schizzi e li trasforma in immagini. È anche possibile creare dal nulla spazio vuoto per creare un’immagine a partire dal contesto nell’area circostante.

Genmoji, Emoji per ogni situazione

L’Intelligenza artificiale Apple trasforma le Emoji in Genmoji. Di fatto si tratta di Emoji dinamiche che si creano sulla base di una descrizione oppure sulle immagini di parenti e amici.

Un utente crea una Genmoji di una persona chiamata Vee, disegnata in modo da sembrare una pilota di una macchina da corsa.

Ai è in azione con le foto

L’app foto viene molto migliorata da Apple Intelligence. Ecco le principali funzioni

- La ricerca usa espressioni naturali. Si possono infatti usare espressi come maglietta colorata” oppure “Katie con adesivi sulla faccia”.

- La ricerca dei video consente di identificare un momento specifico in un clip e andare direttamente a quella sequenza.

- Lo strumenti Clean Up, rimuovere gli oggetti indesiderati dallo sfondo

- Ricordi crea storie, elabora filmati e propone una colonna sonora inserendo una descrizione (ad esempio: crea la galleria delle vacanza al mare). Poiché sa riconoscere il linguaggio e le immagini, Apple Intelligence selezionerà le foto e i video che meglio rispecchiano la descrizione

Una nuova era per Siri

Siri è tra gli elementi del sistema operativo che ha beneficiato delle maggiori novità. Grazie all’integrazione con Apple Intelligence, ora Siri, che ha una nuova veste grafica (un fascio luminoso che circonda lo schermo) offre un’esperienza ancora più integrata.

Essendo in grado di interagire in modo più personale, naturale e contestualmente pertinente, permettendo di semplificare e velocizzare le attività di ogni giorno. L’intelligenza di Siri è basata sui dati presenti nel dispositivo

Siri è in grado di offrire intelligenza su misura dell’utente e delle sue informazioni on-device, come trovare i dettagli di un volo imminente o tener traccia di una prenotazione per cena.

Della nuova Siri parliamo altrove

Trascrizione del testo audio

In Note e Telefono è possibile registrare, trascrivere e riassumere i contenuti audio (quando necessario l’interlocutore viene avvisato)

Per chi è, quanto costa e quando arriva Apple Intelligence?

Apple Intelligence è gratuito e sarà disponibile come parte di iOS 18, iPadOS 18, e macOS Sequoia già quest’autunno in inglese americano (US).

Come si sapeva sarà in beta ma oltre a questo, come abbiamo accennato, non solo alcune funzioni, piattaforme software verranno posticipate, ma sarà possibile sperimentarle solo con la lingua del dispositivo impostata su inglese americano.

Ulteriori lingue arriveranno “nel corso del prossimo anno”, dice Apple. Non è chiaro (ma è probabile di no se il passato sarà maestro) se l’Italiano sarà subito nel secondo lotto o se si dovrà attendere più avanti.

Più chiaro è invece il fatto che Apple Intelligence, per tutte quel che abbiamo detto sulla potenza di calcolo, sarà riservato ad un limitato numero di dispositivi: iPhone 15 Pro, iPhone 15 Pro Max, e iPad e Mac con M1 e tutti i modelli successivi