L’Intelligenza Artificiale ha convinto tutti con chatbot e generatori di immagini AI, purtroppo finora per la generazione di video si è visto molto di interessante, ma ancora poco di realistico e privo di artefatti che tradivano l’origine: tutto può cambiare con Google Lumiere che nel documento di presentazione viene definito in grado di offrire risultati all’avanguardia nella generazione di video dal testo.

Finora i principali modelli AI per generare video da testo partono da fotogrammi chiave per generare quelli intermedi mancanti. Ma in questo modo vengono introdotte deformazioni o imprecisioni visibili tra frame.

Google Lumiere, modello di diffusione testo – video

Per superare questa sfida, definita fondamentale per il settore, i ricercatori Google, in collaborazione con l’università di Tel Aviv e Weizmann Institute of Science, hanno creato Google Lumiere, un modello di diffusione testo – video progettato per generare video con movimenti realistici, diversificati e coerenti.

Finora i video generati da AI non risultano coerenti perché lavorano su singoli keyframe, al contrario il modello di Google genera l’intera durata temporale del video in una sola volta, in un singolo passaggio nel modello. In questo modo il modello impara a generare video in bassa risoluzione a frame rate completo elaborando molteplici scale spazio temporali.

Creazione ed editing video per chiunque

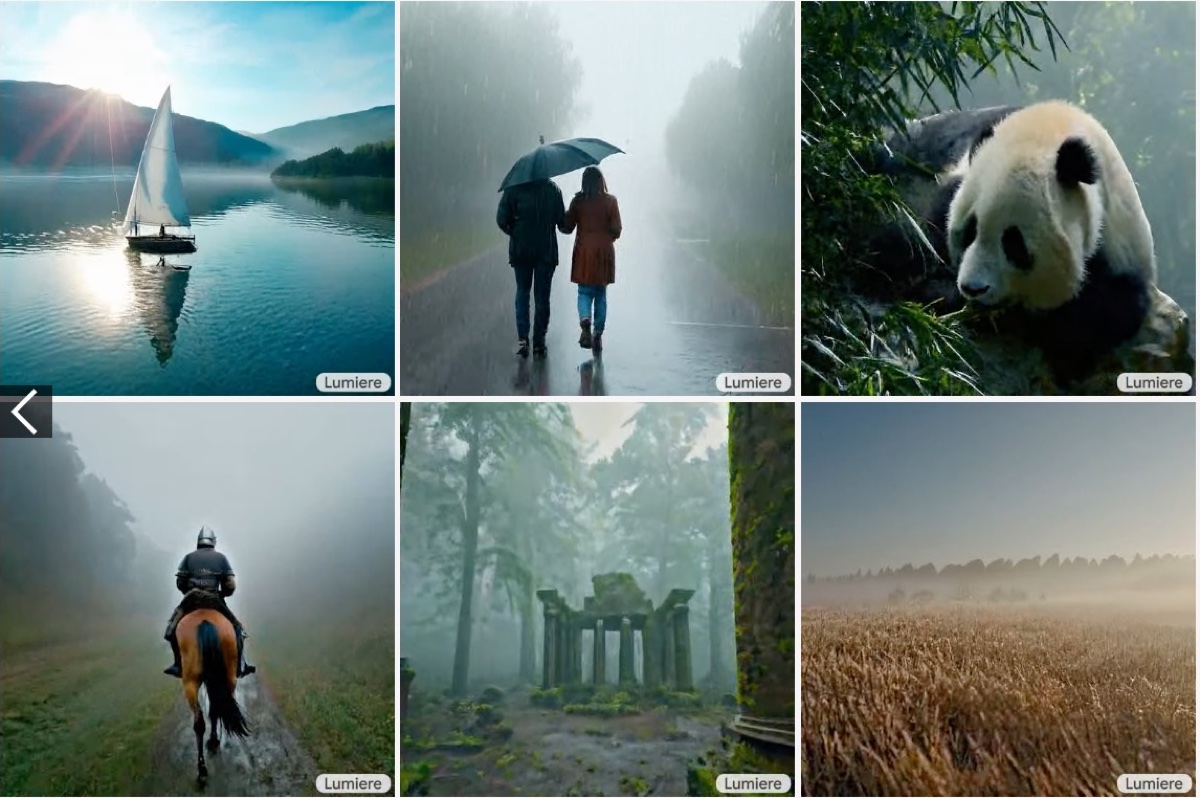

I risultati sono impressionanti non solo per la qualità video superiore, ma anche per le enormi potenziali creative che questo modello mette a disposizione di chiunque, anche che non sa nulla di video digitale, editing, tracc audio e così via.

Grazie al controllo completo su singoli keyframe e sull’intero video Google Lumiere mette a disposizione potenti funzioni creative facilissime da usare. Oltre a descrivere in testo e parole per generare video è possibile farlo a partire da una singola immagine, quindi da immagine a video.

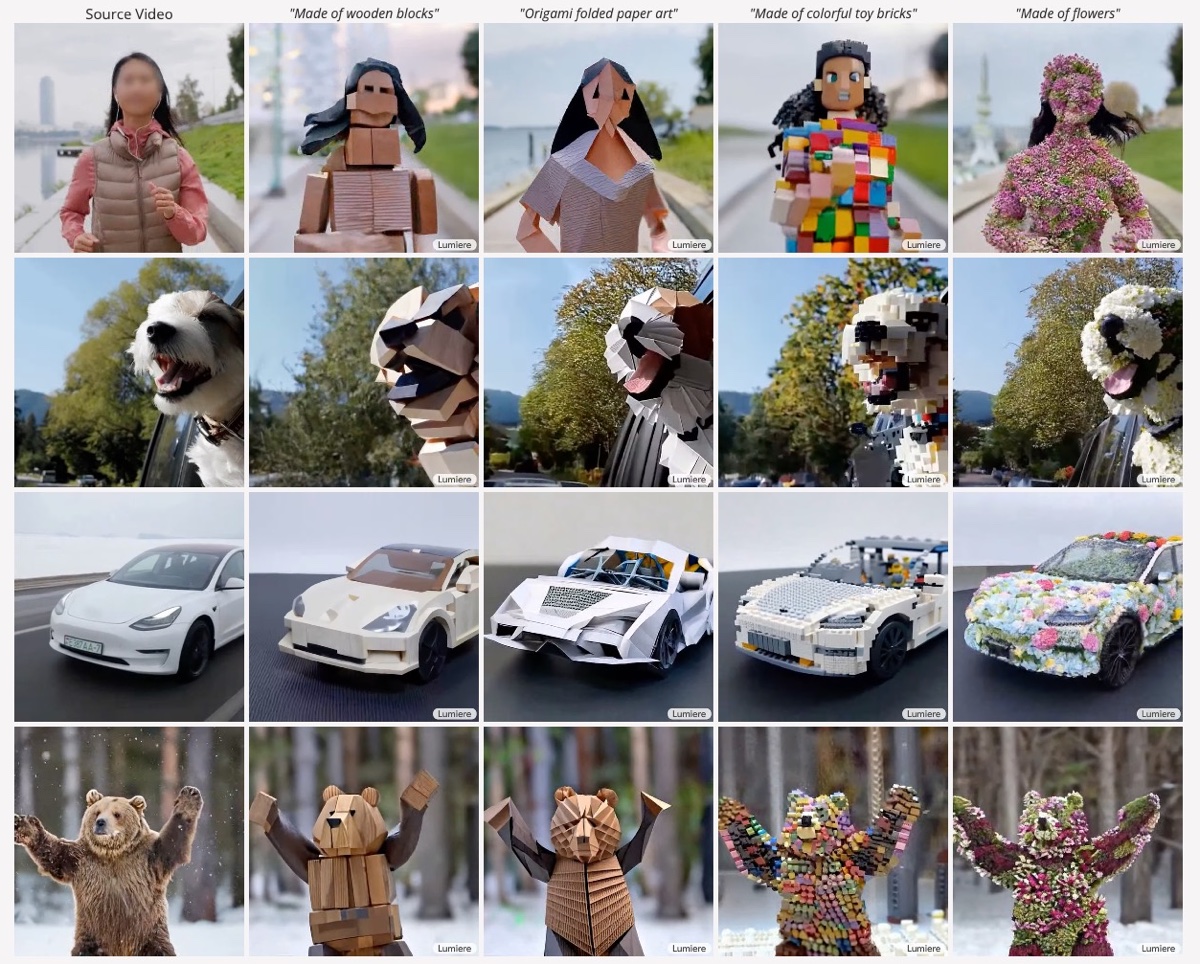

Non solo: l’utente può dare in pasto a Lumiere una singola immagine, qualsiasi, per poi creare un video con qualsiasi soggetto in movimento, ma che viene sempre creato con stile grafico e colori dell’immagine fornita come esempio. Questa è la generazione stilizzata.

Le possibilità di modifica e intervento sui video sono infinite. L’utente può evidenziare un oggetto o soggetto nel video per poi digitare in testo le modifiche desiderate e vederle comparire all’istante.

Per esempio in un video di una ragazza che corre nel prato selezionando al volo con un riquadro il vestito è possibile scrivere a righe, di colore rosso o come lo si vuole per vedere all’instante frame e video modificati come richiesto da AI.

È anche possibile creare all’istante Cinemagraphs, letteralmente cinemagrafici. Con un riquadro si evidenzia oggetto o soggetto desiderato in una immagine e Lumiere crea al volo un video che anima solo la parte desiderata dell’utente.

La parola diventa video, dettagli inclusi

Infine con il video inpainting è possibile modificare al volo colori di vestiti, oggetti e particolari, creare zone oscurate e altre operazioni che finora avrebbero richiesto competenze in materia e che ora invece sono alla portate di chiunque.

Il documento di Big G dichiara che l’obiettivo di Lumiere è di permettere agli inesperti di generare contenuti video. Ed è proprio l’estrema facilità d’uso che aumenta i rischi di uso improprio e per la generazione di contenuti falsi, fake news e fake video. I ricercatori Google ritengono “Sia di importanza cruciale sviluppare e utilizzare strumenti che possano individuare bias e casi d’uso malevoli, al fine di garantire un utilizzo sicuro ed equo”.

Per il momento il modello non è disponibile al pubblico: è addestrato su 30 milioni di filmati accompagnati da descrizioni testuali ed è in grado di generare video della durata di cinque secondi alla risoluzione di 1.024 x 1.024 pixel. È possibile saperne di più su Lumiere dal mini sito dedicato e dal documento di ricerca pubblicato.

Tutte le notizie che parlano di Intelligenza Artificiale sono disponibili a partire da questa pagina di macitynet

![iGuide per i regali di Natale - macitynet..ti CTA Natale iGuida [per Settimio] - macitynet.it](https://www.macitynet.it/wp-content/uploads/2025/12/regali-di-natale-consigli-di-macitynet.jpg)